IASLonline NetArt: Theorie

Thomas Dreher

Geschichte der Computerkunst

IV. Bilder in Bewegung

IV.1 Video Tools

- IV.1.1 Videokulturen

- IV.1.2 Videosynthesizer

- Inhaltsverzeichnis

- Bibliographie

- voriges Kapitel

- nächstes Kapitel

Video ist ein Mitte der sechziger Jahre aufkommendes Filmsystem zur Erzeugung und Speicherung elektronischer Signale. Mobile Elemente des Videosystems sind Kamera und Aufnahmegerät, während das mit einer Kathodenstrahlröhre (eines Fernsehers) verbundene Abspielgerät nicht zu Aufnahmeorten bewegt wird. Auf Magnetbänder gespeicherte Signale enthalten die Informationen, die Abspielgeräte einer Kathodenstrahlröhre für Videopräsentationen zuführen.

Aus der Kombination von Bildern (Kadern) auf einem Filmstreifen wird durch das Vorführgerät eine den Film vorführende Projektion: Während der Film als maschinell bewegte Bildsequenz und Lichtprojektion vorgeführt wird, werden im Videosystem Elektronenstrahlen in einer Vakuumröhre gelenkt. Eine Licht emittierende Videopräsentation ersetzt die Filmprojektion im dunklen Präsentationsraum.

Der Zelluloidstreifen, der sich Kader für Kader (Einzelbild als Phasenbild) am Schneidetisch bearbeiten ließ, wurde vom Magnetband, vom Videoschnittrecorder und von "Tools" für "Electronic Image Processing" abgelöst. Die Transformation des elektronischen Signals durch Mixer, Sequenzer, Switcher, Keyer und andere ersetzt Trickfilmtechniken, die seit Ende des 19. Jahrhunderts für Einzelbildbearbeitung und Montage entwickelt wurden. 1

In den sechziger und siebziger Jahren experimentierten Stephen Beck, Robert Cahen, Tom DeFanti, Tom DeWitt, Ed Emshwiller, Bill Hearn, Barbara Aronofsky Latham, Phil Morton, Nam June Paik, Eric Siegel, Barbara Sykes, Stan VanDerBeek, Steina und Woody Vasulka, Jim Wiseman und andere mit Prozessoren, Synthesizern sowie Analog- und Digitalcomputern. 2

Die Signalproduktion kann mit Videokameras erfolgen, die Bildsignale einer Magnetbandspeicherung zuführen, muss aber nicht: Signalverarbeitende Systeme können Dateninput verschiedener Quellen in Daten verwandeln, mit denen ein Elektronstrahl in einer Vakuumröhre steuerbar ist. Neben Videokameras können auch Musiksynthesizer (zum Beispiel von Robert Moog oder Don Buchla 3) Input an Systeme liefern, die ihn in Signale für die Monitorpräsentation umwandeln. So war Stephen Becks "Direct Video Synthesizer" (1970) an einen Buchla Synthesizer angeschlossen, dessen Audiosignale von Ersterem in visuelle Signale umgewandelt wurden (s. Kap. IV.1.2).

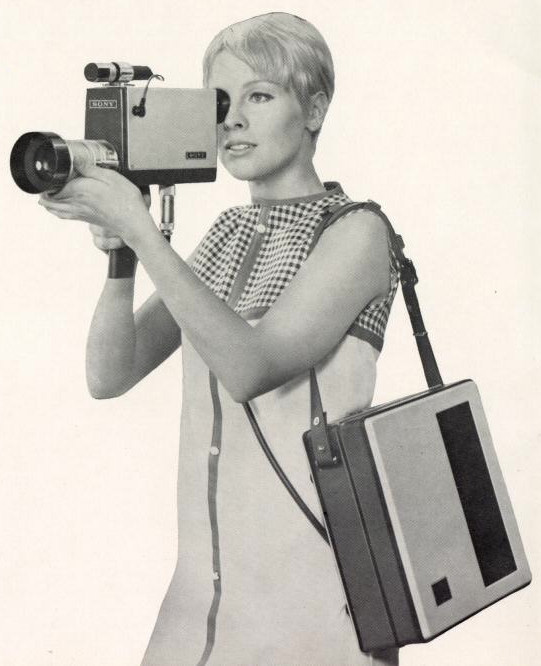

Bevor diese und andere Arten der Signalproduktion mittels analoger Rechenprozesse in Videosynthesizern entstanden, wurde Video durch Aufnahmegeräte bekannt, die im Vergleich zu professionellen Filmkameras leicht waren. Die ab 1965 erwerbbaren Videokameras waren noch über eine Leitung mit einem nicht portablen, weil zu schwerem Aufnahmegerät für Magnetbandspeicherung verbunden (Sony VCK 2000). Zwischenstufen wie die Filmentwicklung entfielen. Die Reichweite der Kamera war von der Länge der Leitung zum Aufnahmegerät abhängig. So wurde das Videosystem mit einem auf das Aufnahmegerät gesetzten Monitor zur Aufnahme von Personen angeboten, die sich in der Nähe dieses Gerätes aufhielten und sich auf dem Monitor sehen konnten: Home Video Tape Recording. 4

Sony VCK 2000, ab 1965. Frau mit Mikrophon und Mann mit Videokamera auf Stativ. Dahinter: Aufnahmegerät mit Magnetband und Monitor. Foto: Sony.

Ab 1968 wurde das Sony Porta Pak Ensemble (Sony Porta Pak CV 2400) mit leichtem, über der Schulter tragbarem Videorecorder und Videokamera zu einem mobilen System für Live-Aufnahmen. Die Magnetbänder erlaubten, 20 Minuten lange Sequenzen zu speichern. Das an einen Fernseher angeschlossene Abspielgerät ermöglichte es, Bänder sofort nach der Aufnahme abzuspielen. Ab 1970 konnte auch in Echtzeit das Aufgenommene am Aufnahmeort mit dem tragbaren Videorecorder vom Band abgespielt und im Kamerasuchfeld betrachtet werden (Sony Porta Pak AV 3400). 5

Sony Porta Pak CV 2400, ab 1968. Links: Frau mit Videokamera und tragbarem Videorecorder. Rechts: Videokamera. Fotos: Sony.

Das Videoaufnahmesystem war billiger und leichter als die Aufnahmegeräte, die Anfang der siebziger Jahre noch Kamerateams von Fernsehsendern einsetzten, bevor auch sie zu Videosystemen wechselten. 6 Aktivisten nutzten Video als Möglichkeit, Menschen aus sozialen Kontexten, über die Fernsehsender nicht berichteten, in Workshops Kenntnisse zur Erstellung von Videofilmen vermitteln, mit denen sie ihre soziale Situation aufzeigen und ihre Ursachen anprangern konnten. So wurden Menschen aus sozialen Kontexten, über die Fernsehsender nicht berichteten, Möglichkeiten zur Darstellung ihrer Probleme geboten. 7 Zusätzlich zur Verbreitung der Videodokumentationen durch das Verschicken von kopierten Magnetbändern bot das in den siebziger Jahren in Amerika ausgebaute Kabelsystem Möglichkeiten für nicht kommerzielle, werbefreie lokale Sender, deren Inhalte die Einwohner selbst bestimmten (Community TV).

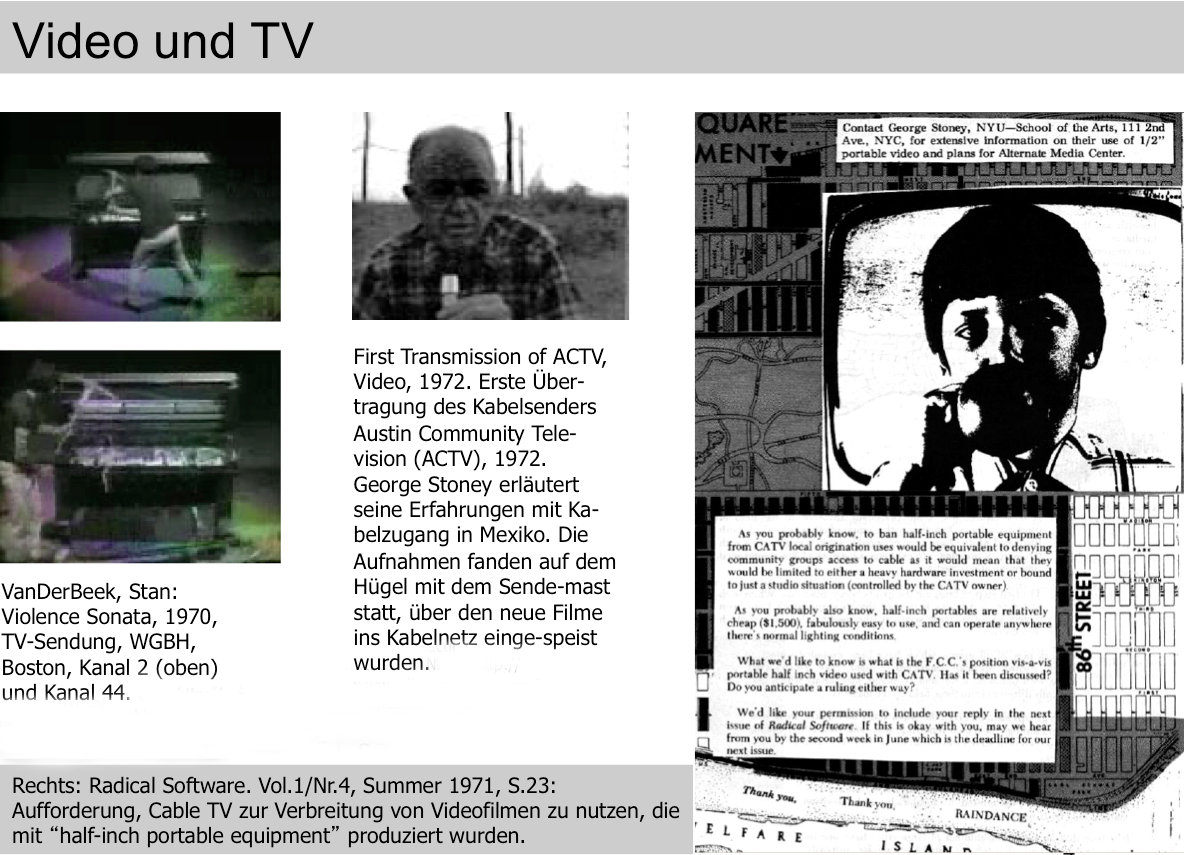

Die bekannten privaten Fernsehsender nutzten für Antennenempfang Kanäle im Hochfrequenzspektrum. Um Interferenzen zu vermeiden, war nur eine begrenzte Zahl von Frequenzen verfügbar, um die ein Verteilungskampf zwischen privaten Fernsehsendern entstand: Die Nutzung der verfügbaren Frequenzen wurde teuer. Im Kabelfernsehen gibt es diese Einschränkungen des Commercial Broadcast nicht. Pionier der Nutzung von Cable TV für Videoaktivisten wurde George Stoney. Stoney realisierte 1972 die erste Sendung für das Austin Community Television (ACTV), indem er sich vor der Antenne filmen liess, über die das Gefilmte live in das Kabelnetz eingespeist wurde. Stoney berichtete über seine Erfahrungen mit Kabelzugang in Mexiko. 8

Neben den aktivistischen Bemühungen um alternative Dokumentationen und Community TV gab es Künstler, die in über Antennenempfang erreichbaren Sendungen experimentelle Formen einbrachten. Mit Videotechniken entwickelbare Filmformen sollten Bestandteil neuer Sendeformen werden, zu denen als Novum auch Zuschauerbeteiligung gehörte. Der Bostoner Sender WGBH-TV produzierte ab 1969 Videos und Sendungen von Künstlern, die er auch technisch unterstützte.

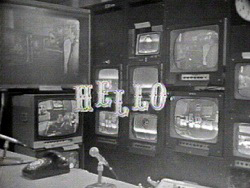

WGBH-TV hatte ein Kamera-Netzwerk für Echtzeit-Übertragungen (Closed-Circuits) von öffentlichen Institutionen wie dem Massachusetts Institute of Technology (MIT) in der "Boston-Cambridge area" eingerichtet, das Allan Kaprow 1969 in "Hello" einsetzte. Die Aktionen vor externen Kameras wurden im WGBH-TV Studio auf 27 Monitoren angezeigt. Das Video "Hello" dokumentiert einige von Kaprows Aktionen im Studio beim Hin- und Herschalten zwischen den Kameras und bei der Interaktion mit Akteuren, die sich vor diesen Kameras bewegten. 9

Kaprow, Allan: Hello, TV-Sendung "The Medium is the Medium",

WGBH, Boston, Video, 1969.

Im März 1969 stellte WGBH-TV in The Medium is the Medium" sechs Videos vor, die Künstler für diese Sendung realisierten: Neben "Hello" wurde auch Nam June Paiks "Electronic Opera #1" gesendet. Paiks Video zeigte eine Tänzerin mit freiem Oberkörper, zwei sich Küssende, Richard Nixon, Hippies und andere in mit einem Magnet manipulierten TV-Bildern. Auf oder vor diesen Bildern schwebten Transformationen von drei auf- oder übereinanderliegenden grün-blauen Achterschleifen, die durch direkte Bearbeitung des elektronischen Signals entstanden. 10

Paik, Nam June. Links: Electronic Opera #1, WGBH-TV, Boston, Video, 1969.

Rechts: Video Commune – The Beatles from Beginning to End, WGBH-TV, Boston, Video, 1970.

Der Fernsehsender WGBH-TV finanzierte die Entwicklung des "Video-Synthesizers" von Nam June Paik und Shuya Abe. Das Studio des Senders erhielt den ersten "Synthesizer". Er wurde 1970 zum ersten Mal in der Sendung "Video Commune – The Beatles from Beginning to End" eingesetzt. 11 Unter der Regie von David Atwood realisierte Paik mit dem Synthesizer Videoanimationen zum Oeuvre der Beatles. Paik lud Passanten ins Studio, die ebenfalls den Synthesizer bedienten.

Stan VanDerBeek verknüpfte 1970 in der vom WGBH-TV produzierten "Violence Sonata" Participation TV, das in "Hello" nur als dokumentierte Aktion gezeigt wurde, mit Experimentalfilmen: Er kombinierte die Kanäle 2 und 44 des Senders. Nur wer 2 Fernseher nebeneinander stellte, konnte auf Kanal 2 mit "overlays and color saturation" bearbeitetes Filmmaterial und simultan auf Kanal 44 ein Studiopublikum sehen, das Live über die gezeigten Filme diskutierte. Außerdem konnte jeder Fernsehzuschauer via Telefon mit drei Diskussionsteilnehmern sprechen. Stan VanDerBeek erweiterte in "Violence Sonata" seine Experimente mit elektronischer Bildbearbeitung, die er und Kenneth Knowlton mit "Poem Fields" 1964 in den Studios der Bell Telephone Gesellschaft begannen (s.Kap. IV.2.1.2), zum TV-Experiment. 12

Als Provokation der Spielfilmpräsentation im Kino wie des Massenmediums Fernsehen verstanden Experimentalfilmer wie Künstler ihre Konzepte für alternativen Mediengebrauch. Partizipation sollte das Publikum aus seiner passiv konsumierenden Beobachterposition befreien. So schrieb Nam June Paik 1971:

Communication means the two-way communications. One-way communication is simply a notification...like a draft call. TV has been a typical case of this non communication and mass audience had only one freedom, that is, to turn on or off the TV. 13

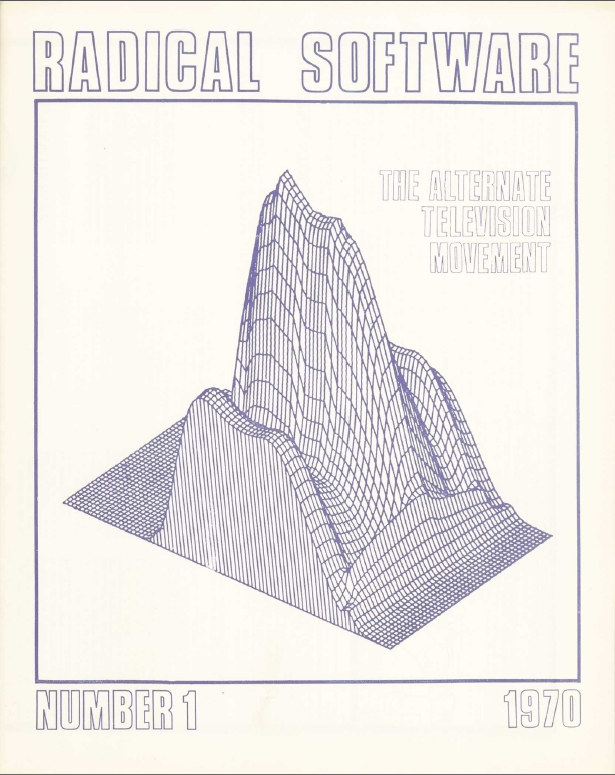

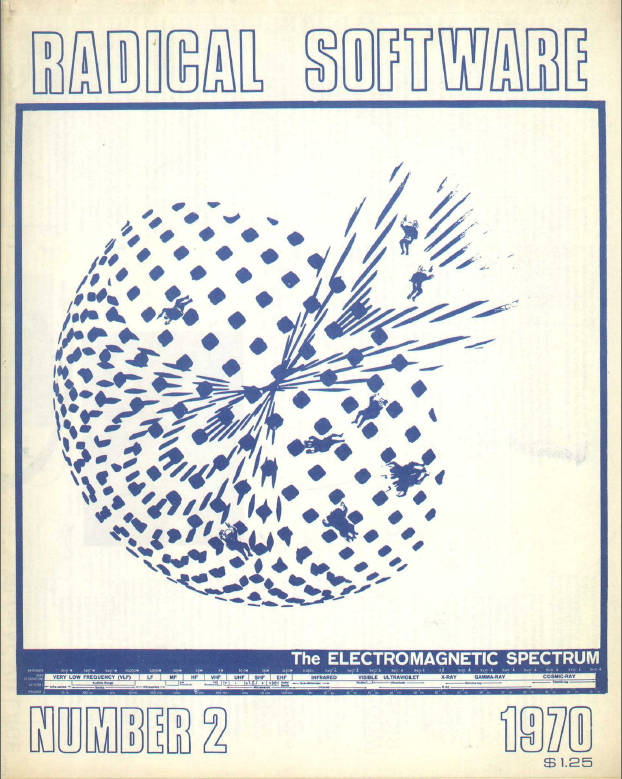

Die Videozeitschrift "Radical Software" erschien zwischen 1970 und 1974 in elf Ausgaben. Informationen über Aktivitäten der Medienaktivisten wie der Experimentalfilmer wurden in der von Phyllis Gershuny, Beryl Korot, Michael Shamberg und Anderen herausgegebenen Zeitschrift publiziert. 14 Die Video-Aktivisten informierten über das Angebot an verschickbaren Dokumentationen sozialer Missstände durch die selbst filmenden Betroffenen und über Community TV, während die Experimentalfilmer neue technische Möglichkeiten vorstellten. Der Videoeinsatz der Experimentalfilmer mit für ihre Zwecke entwickelten Video Tools und der Videoeinsatz der Aktivisten, der sich auf `vor Ort´ gedrehte Filme über soziale Probleme konzentrierte, die in kurzer Zeit editier- und distribuierbar waren, waren alternative Strategien zur Entwicklung neuer Medien und neuer Formen des Mediengebrauchs, die sich auf der Suche nach neuen Formen des Fernsehens wechselseitig ergänzen konnten.

Radical Software, Vol.1/Nr.1 und Nr.2, 1970.

Aus Medienkritik an der "Bewußtseins-Industrie" und ihrer "one-way communication" ergab sich das Ziel einer "participatory democracy", in der sich alle Bürger am Community TV beteiligen (können). 15 Auch Video Tools konnten – wie es Paik in "Video Commune" vorführte – öffentlich zugänglich werden.

Videosynthesizer und Prozessoren waren Analogrechner, die zur Bilderzeugung mittels einer Steuerung von Elektronen in Kathodenstrahlröhren konstruiert wurden. Zum Teil konnten die Bewegungen des Elektronenstrahls nur gespeichert werden, indem sie von Monitoren abgefilmt wurden. 16

Mary Ellen Bute mit ihrem Oscillographen. Foto: Ted Nemeth, um 1954. Courtesy Center for Visual Music (Zinman: Circuit 2012, S.140).

Animationen, die mittels Manipulationen von Elektronenstrahlen in Oszillographen erstellt und deren Bildschirme abgefilmt wurden, waren Vorläufer dieser Technik. Benjamin Francis Laposky begann 1950, den Monitor seines veränderten Oszillographen abzufotografieren (s. Kap. III.2). Mary Ellen Bute verwendete 1952-53 einen für ihre Zwecke von Ralph K. Potter, dem Direktor des Department for Transmission Research der Bell Telephone Laboratories, gebauten Oszillographen in den Filmen "Abstronic" (1952) und "Mood Contrasts (1953) als Mittel zur Erzeugung von "Visual Music": Musikaufnahmen verwendete Bute als "electrical inputs" und veränderte diese Signale mittels der Knöpfe und Schalter auf ihrem Oszillographen. Die "figures and forms" auf dem Bildschirm des Oszillographen wurden "photographed on motion picture film." 17

Mary Ellen Bute: Abstronic, Film, 1952.

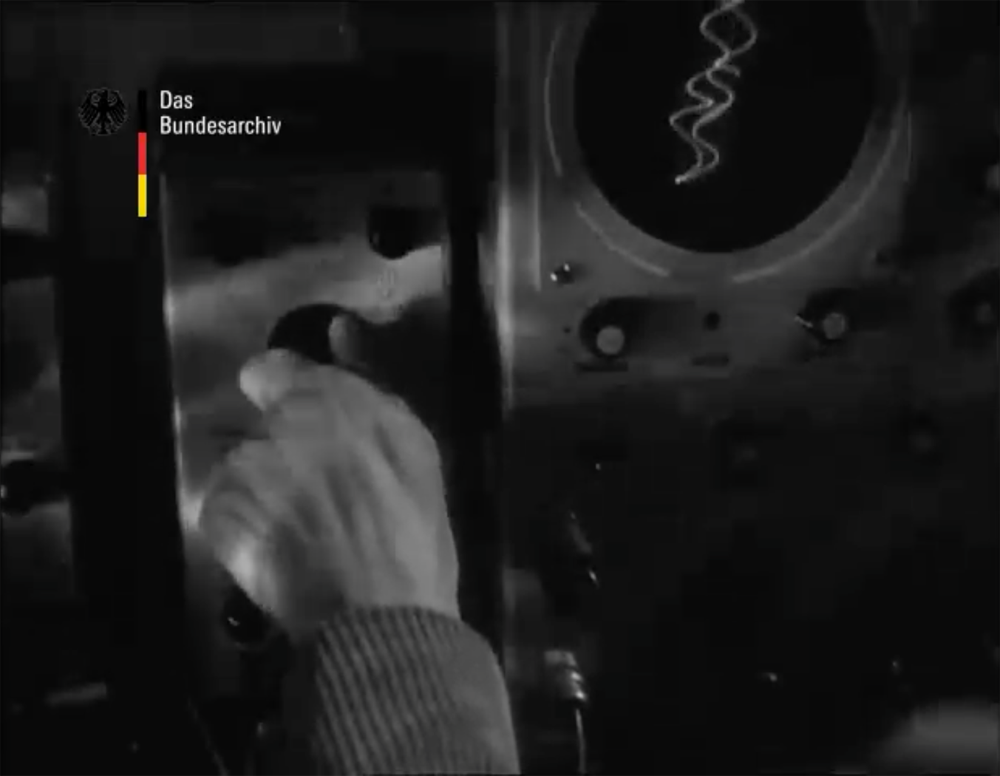

Herbert W. Franke konnte mit dem von Franz Raimann für ihn konstruierten analogen Rechensystem über zwei voneinander abhängige Parameter für Länge und Höhe Kurvenscharen kontrollieren. Franke setzte dieses Rechensystem nicht nur zur Erzeugung analoger Computergrafik (s. Kap. II.1), sondern auch in Filmexperimenten ein. Eine Sequenz der UFA-Wochenschau vom 27.10.1959 zeigte Kinobesuchern (als Vorschau zu Vorführungen von Spielfilmen), wie Franke Bewegungen des Elektronenstrahls eines Oszillographen kontrollierte: Er führte mit in "Echtzeit-erzeugten Animationen" einen "Tanz der Elektronen" vor.

Die "Spannungsschwankungen" eines "Magnetophongerätes" verwendete Franke als "Impulse", die zusätzlich zu Raimanns Analogrechensystem dem Oszillographen zugeführt wurden. Der Film zeigt kurz einige Geräte, "vermutlich Adapter, Filter, Potentiometer usw.", mit denen Franke die Impulse des Magnetophongerätes integrieren konnte. Die so erzeugte Steuerung des Bildschirms durch Musik "deutet sich in den letzten Sekunden des Films an, wo tatsächlich auf die Musik abgestimmte Bewegungen einiger Bildelemente zu sehen sind." 18

Der Eigenbau von Raimann (aus Bedienelement und analogen Elementen für Rechenprozesse) und der angeschlossene Monitor, der abgefilmt wurde, antizipierten die Technik, die in den siebziger Jahren zur Produktion experimenteller Videos eingesetzt wurde: Aus Raimanns Element mit Verbindungssteckern wurden bei den Videosynthesizern der siebziger Jahre Patch-Cables, die zur Steuerung der Elektronenstrahlen auf Kathodenstrahlröhren (unter Anderem von Fernsehern) verwendet wurden.

Prozesse der Bildproduktion wurden bestimmt von elektronischen Signalen, die nur über Kontrollgeräte beeinflussbar waren: Die Arbeit der Erstellung von Filmstreifen Bild für Bild am Schneidetisch entfiel – und damit entfielen auch die dafür entwickelten Animationstechniken. Die Aufnahmen des Oszilloskops, die der Kameramann der UFA mit einer Filmkamera machte, nahmen spätere Aufnahmen mit Videokameras von Bewegungen der Elektronenstrahlen vorweg, wie sie auf Bildschirmen sichtbar wurden.

Herbert W. Franke: UFA-Wochenschau

170/1959, Film, 27.10.1959. Kameramann: Vlasdeck.

Oben: Bildschirm des Oszillographen.

Unten: Steuerelemente links neben dem Oszillographen, mit denen Franke

die von Franz Raimanns Analogrechensystem erzeugten Bildschirmereignisse

in Echtzeit nachregulieren kann.

Das «Luminoscope 1» (1959) hat nach seinem Schöpfer Nicolas Schöffer "äußerlich die Form eines Fernsehgeräts mit Bedienungsknöpfen, die direkt am Gerät oder getrennt davon (Fernsteuerung) angebracht sind." Die Möglichkeiten dieses die Elektronen einer Kathodenstrahlröhre steuernden Geräts, "Farbbilder mit Reliefwirkung und vieldimensionalen Bewegungseffekten" zu erzeugen, wurden am 25. Oktober 1961 im Französischen Fernsehen (ORTF) in Schwarzweiß vorgestellt: Aufnahmen von einer Jazzkombo (Martial Solal Trio), einem Gospelsänger (Gordon Heath) und zwei Balletttänzern (Hélène Longuet und Jean Beaufort) wurden in «Variations luminodynamiques 1» mit dem Luminoskop mit weiteren, nicht-darstellenden und meist transparenten Bildebenen gemischt. Die Bildmanipulationen nehmen Verfremdungen späterer Video-Prozessoren und Synthesizer vorweg. 19

Nicolas Schoeffer: Luminoscope I, 1959.

Nicolas Schoeffer: Variations luminodynamiques, Film, 1961. Dokumentation der TV-Sendung: ORTF, 25. Oktober 1961.

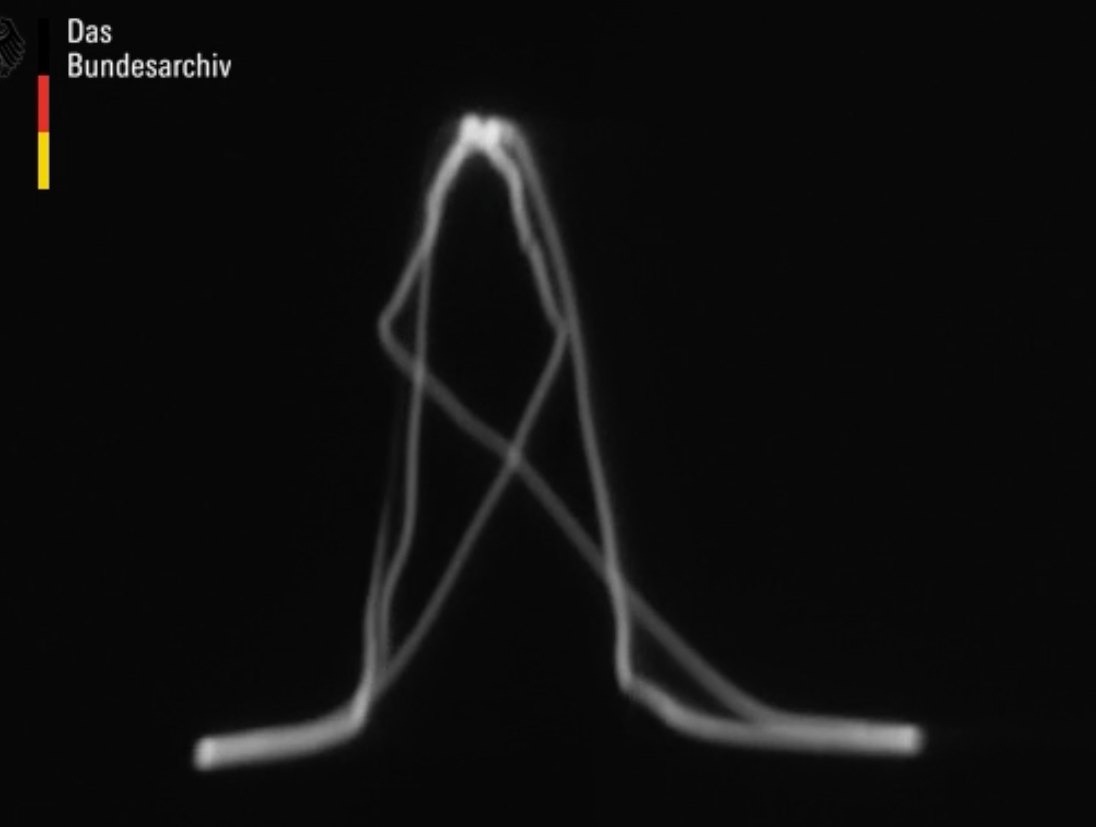

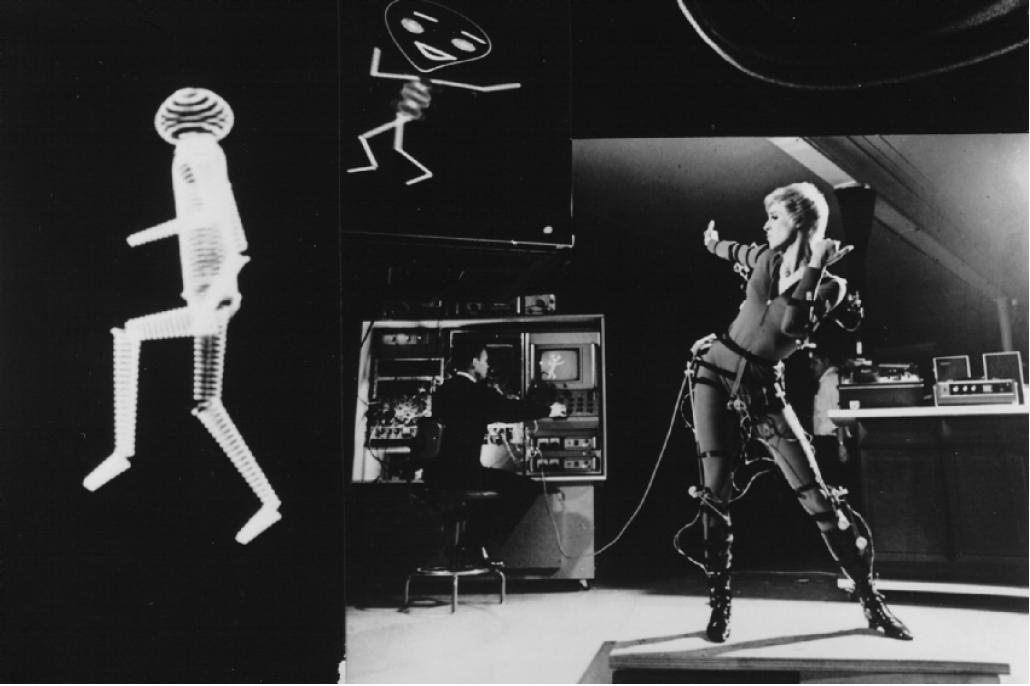

Lee Harrison III entwickelte seinen "Bone Generator" (Ende der fünfziger Jahre) weiter zu ANIMAC (zwischen Weihnachten 1959 und Neujahr 1960). Das in Röhrentechnik gebaute Animationstool enthielt "a patchy panel, potentiometers, joysticks, dance interfaces, and a flying spot scanner. Analog and simple digital circuits were patched together physically through the patch panel..." Mit ANIMACs "patch panel" ließen sich Strichfiguren erstellen, die auf einem XY Oszilloskop präsentiert wurden. Die Striche oder "Bones" der darzustellenden Figuren waren "basically line segments". "Surface characteristics" wurden mit "`spinning vectors´ called Skin" gespeichert. Diese Vektoren bestanden aus "high frequency sin/cosine oscillators." Deren Output lieferte "the three electronic signals representing the animation´s image." Die Perspektive einer mit desem "3D-output" erzeugbaren Animation ließ sich mit einem "Camera-Angle Network" bestimmen. Dieses "Network" übersetzte die "three signals" einer Animation "into two signals" ("2D perspective"). Die zwei Signale für die Darstellung wurden an das Oszilloskop geschickt. Dessen Bildschirm wurde gefilmt. Für Farbfilmaufnahmen wurden Farbfilter zwischen Oszilloskop und Kamera angebracht.

Teilnehmer mit am Körper befestigten Sensoren konnten die Bewegungen der Strichfiguren in Echtzeit steuern. Die Sensoren reagierten auf Körperbewegungen und veränderten die Spannung, worauf wiederum die Animation reagierte. Die Spannung steuerte Kontrollsignale, die in einer 3D-Rotationsmatrix die Strichfigur bewegten. 20

Harrison III, Lee: ANIMAC, 1962. Eine Tänzerin steuert die Animation eines Strichmännchens, indem sie Sensoren aktiviert, die an ihrem Körper befestigt sind. Denver 1962 (Fotomontage).

Vor Lee Harrisons nächster Entwicklung, dem "SCANIMATE" (1969, s.u.) mit umfassenden Möglichkeiten zur Produktion von Animationen, stellten Ture Sjölander, Robert Cahen und Eric Siegel Videos mit Verfahren der Umlenkung des Elektronenstrahls vor, die sie mit dafür konstruierten Apparaten realisierten. Sie konnten technische Geräte einsetzen, die über Manipulationen von Fernsehern mittels Veränderungen der Einstellungen und Magneten 21 hinaus reichten, aber – im Vergleich zu den Videosynthesizern der Siebziger Jahre – noch wenig Funktionen ausführen konnten.

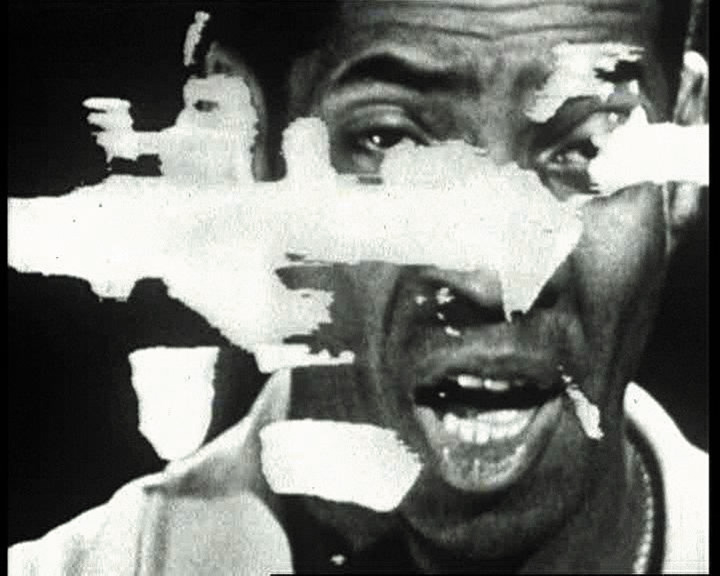

So realisierten Ture Sjölander, Bror Wikström und Bengt Modin 1966 die 30-minütige Sendung "Time" für die Schwedische Fernsehanstalt (Sveriges Radio, Stockholm) mit ihrem "Temporar Video Synth" (1966-69), indem sie die schwarz-weiße Filmdokumentation eines Jazz-Quintetts (von Don Cherry) verfremdeten: Das Videosignal, das den Elektronenstrahl lenkt, wurde durch einen Funktionsgenerator (auch: Waveform Generator) abgelenkt. Außerdem wurde das Leuchtdichte-Signal ("luminance signal") durch elektronische Filter verändert. 22

Ture Sjölander/Bror Wikström/Bengt Modin: Time, 1966. Film für Sveriges Radio (Stockholm).

In der Sendung "Monument", die 1967 in Frankreich, Italien, Schweden und Deutschland gesendet wurde, verfremdeten Sjölander und Lars Weck Fotoporträts und Kurzfilme berühmter Persönlichkeiten, indem sie diese in einem Video montierten, das Video abfilmten und es auf eine Fotozelle mit einer gerasterten Lichtquelle projizierten. Dieser Lichtstrahl wurde mit Ablenkspannung gestört. Schwingungszahl und Schwingungsweite (Frequenz und Amplitude) der Verzerrungen wurden wieder mit Funktionsgeneratoren verändert, die später auch in Videosynthesizern eingesetzt wurden. 23

Ture Sjölander/Lars Weck: Monument, 1967. Film für Sveriges Radio, Stockholm, Januar 1968.

Francois Coupigny konstruierte 1968 mit dem «Truqueur Universel» einen Prozessor, dessen Module zur Bildmanipulation und Kolorierung über Schieberegler steuerbar waren. Robert Cahen setzte den Prozessor 1973 in dem Video «L´invitation au voyage» ein, um schwarz-weiße Fotos einer Stadt und Filmaufnahmen (16 mm) in der Provence durch Farbüberlagerungen zu verfremden – Robert Cahen:

I tried at the same time to make the black and white photos come alive, their colours becoming superimposed giving a semblance of movement to the frozen image and that fascinated me. 24

Mit dem im Off gesprochenen französischen Text (von Jo. Attié) über «cette petite gare de Provence» erweitert Cahen die Videoexperimente zum von elektronischer Musik untermalten Videoessay. 25

Robert Cahen: L´invitation au voyage, Video, 1973.

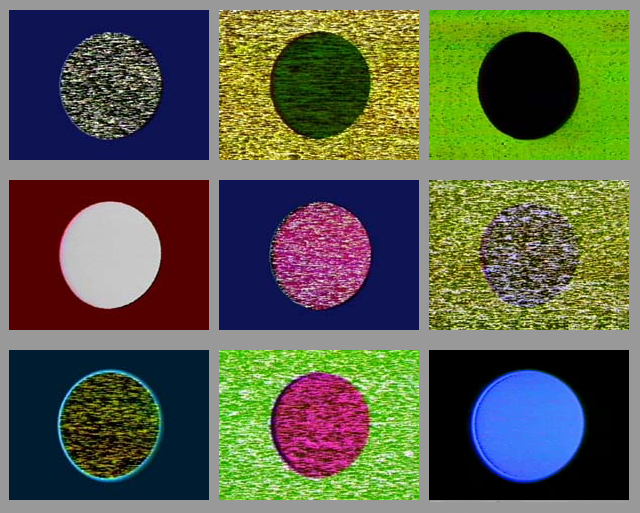

Eric Siegel zeigte "Psychedelevision in Color" (1968-69) in der Ausstellung "TV as a Creative Medium" der New Yorker Howard Wise Gallery. Mit einer tragbaren Kamera gemachte Aufnahmen veränderte Siegel mit einem "video effects generator" und kolorierte sie mit seinem "Video Colour Synthesizer" (auch "Processing Crominance Synthesizer", 1968-69), mit dem die Grauwerte eines Signals auf dem Bildschirm eines Fernsehers in Farbtöne umgewandelt wurden. 26 Da sich die mit der ersten Version des Synthesizers erzeugte Steuerung des Elektronenstrahls nicht speichern ließ, wiederholte Siegel die Realisation "Einstine" (einer der drei Teile von "Psychedelevision") nach der Ausstellung: In diesem Dokument wird ein Porträtfoto Albert Einsteins mittels Videofeedback und Kolorierung in "psychedelic effects" 27 aufgelöst.

Eric Siegel: Einstine, 1969. Video, Farbe, Ton (Kane: Algorithms 2014, S.73).

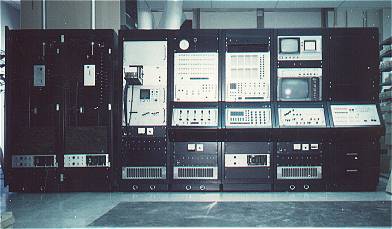

Als Lee Harrison III 1969 SCANIMATE auf der Basis von ANIMAC (s.o.) entwickelte, entschied er sich für Analogcomputer (mit Transistoren) und ein zweidimensionales Animationssystem zur Tranformation gescannter Vorlagen. Harrison integrierte einen Leuchttisch und eine Kamera zur Aufnahme von Zeichnungen mit Animationsfiguren. Mit SCANIMATE ließen sich diese Zeichnungen verändern und auf einer Kathodenstrahlröhre vorführen. Dieser Bildschirm konnte mit einer einfarbigen "NTSC video camera" aufgenommen und gespeichert werden. 28

Harrison III, Lee: SCANIMATE, 1969.

Neuer SCANIMATE 1973

in den Dolphin Productions, New York City.

Ed Emshwiller erstellte "Scape-mates" 1972 mit SCANIMATE im TV Lab des New Yorker Fernsehsenders WNET/Thirteen. 24 schwarz-weiße Zellen in fünf verschiedenen Grautönen wurden zum Ausgangspunkt der Bildbearbeitung. Zwei Kameras der beiden Computer von SCANIMATE lieferten den Input für die Zellen. Die Zellen wurden in Echtzeit sowohl animiert als auch koloriert. Ein Computer lieferte den Hintergrund, der andere den Vordergrund. Aufnahmen von Tänzern wurden teilweise mit "SCANIMATE" bearbeitet, bevor sie im Chromakey-Verfahren im Hintergrund und im Vordergrund eingeblendet wurden. 29 Emshwiller setzte auch den Paik/Abe-Video Synthesizer (s.u.) ein. Auf der Website des 1971 von Howard Wise gegründeten Videovertriebs "Electronic Arts Intermix" wird die Bedeutung von "Scape-mates" für die Entwicklung von Videofilmen hervorgehoben:

With its witty interplay of the `real´ and the `unreal´ in an electronically rendered videospace, and the skilfull manipulation and articulation of sculptural illusion of three-dimensionality, scape-mates introduces a new vocabulary of video image-making. 30

Emshwiller, Ed: Scape-mates, Video, 1972.

Der Steuerung des Elektronenstrahls in der Kathodenstrahlröhre gilt das Hauptinteresse der Entwickler von Video Tools. In der Vakuumröhre wird ein gebündelter Elektronenstrahl zwischen Anode und Kathode auf einen mit Phosphor beschichteten Schirm gerichtet. Elektronische Impulse bilden ein elektromagnetisches Feld zur Stuerung des Elektronenstrahls. Der Elektronenstrahl wird entlang von horizontalen oder vertikalen Achsen, den "xy plotting coordinates", gelenkt. 31 Durch die horizontale und vertikale Lenkung zwischen zwei Magnetpaaren entstehen Vektorbilder in Oszilloskopen und frühen Computermonitoren sowie Rasterbilder in Fernsehgeräten und neueren Computermonitoren (ab Mitte der siebziger Jahre). Rasterbilder sind eine Sonderform der Vektorbilder und setzen Speicherkapazitäten für "bitmaps" voraus, die frühe Computer noch nicht besaßen.

Es gibt im Videofilm – anders als im Film – keine Phasenbilder, die ein Vorführgerät mechanisch in Bewegung versetzt, um filmische Effekte zu erzeugen, sondern für den Aufbau von Rasterbildern wird der Bildschirm durch das Schreiben der "scan lines" mit gelenkten Elektronenstrahlen so aktiviert, dass der optische Eindruck von bewegten Bildern entsteht. Das auf Magnetband gespeicherte "Transformationsbild" 32 wird zur Grundlage des experimentellen Videofilms.

Abe, Shuya/Paik, Nam June: Paik/Abe Video Synthesizer, Modell von 1972, gebaut für WNET/Thirteen, New York, aufgenommen 1982 in Paik´s Atelier (Courtesy Nam June Paik Studios, Inc. In: Joselit: Feedback 2007, S.47).

Der Paik/Abe-Video Synthesizer (s. Kap. IV.1.1 mit Anm.11) war in der ersten Version 1970 kein Synthesizer. Mit ihm ließen sich sieben externe Bildquellen mischen und kolorieren. Die Farben waren umkehr- und manipulierbar:

Combining video feedback, magnetic scan modulation and non-linear mixing followed by colorizing, generated its novel style of imagery. 33

Scan-Prozessoren wie der Paik/Abe-Synthesizer und die hier vorgestellten Tools von Francois Coupigny, Lee Harrison III (SCANIMATE), Ture Sjölander (s.o.), Dan Sandin oder Bill Etra und Steve Rutt (s.u.) starten Signalprozesse mit dem Input von externen Quellen (Kameras). Im Unterschied dazu generieren der "Direct Video Synthesizer" (1970) von Stephen Beck und der "Electronic Video Synthesizer" (1970) von Eric Siegel Signale. Beide Synthesizer können diese generierten Signale mit externem Kamera-Input mischen.

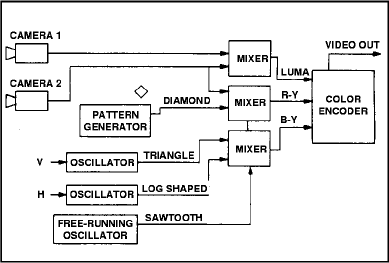

Siegel, Eric: EVS Video Synthesizer, 1970.

Links: Eric Siegel im Büro von Electronic Arts Intermix, New York, ca. 1971.

Rechts: Funktionsdiagramm von Jeffrey Schier.

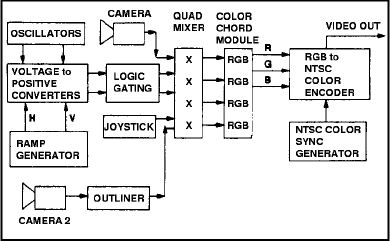

Siegels "Electronic Video Synthesizer" konnte über Generatoren und Oszillatoren bewegte Muster entwickeln. Zwei Mixer führten die Wellen der Oszillatoren und Generatoren zusammen. Der Input zweier Kameras liess sich über einen dritten Mixer zusammenführen. Ein "Color Encoder" bildete das "color video signal" aus den drei Mixern. 34 Siegel beschrieb die mit dem "EVS" entwickelbaren Muster als wählbare symmetrische oder asymmetrische "geometric formations". Ein Filmschaffender konnte sich außerdem entscheiden, ob entweder Muster oder Farben oder beide konstant bleiben oder sich verändern sollten. 35 1973 setzte Siegel in der Performance "Yantra Mantra" im New Yorker "The Kitchen" den "EVS" ein. Die Schwierigkeiten, zeitgenössische Filmdokumente für Realisationen mit dem "EVS" zu finden, sind auf Siegels Desinteresse an Videodokumenten zurückzuführen. Außerdem behinderte er Howard Wise bei Versuchen, den Synthesizer herzustellen und zu verkaufen. 36

Beck, Stephen: Direct Video Synthesizer, 1970. Links: Aufsicht.

Rechts: Funktionsdiagramm von Jeffrey Schier.

Stephen Becks Prototyp des "Direct Video Synthesizers" ("Direct Video #0") enthielt einen umgebauten Farbfernseher mit Möglichkeiten, die Farbgenerierung der Kathodenstrahlröhre zu beeinflussen. Audiosignale, Oszillatoren und externe analoge Mischer waren die Bausteine für die Farbbildung. Die Funktionen für Farbeinstellungen lieferte ein Buchla Synthesizer. 37 Dem zur Klangproduktion in elektronischer Musik eingesetzten Synthesizer fügte Beck einen weiteren analogen Synthesizer hinzu, der sich zur Visualisierung von Klängen einsetzen ließ. Allerdings führte das bei Audiosynthesizern übliche Frequenzspektrum nicht zu interessanten Visualisierungen. Mit Fördergeldern des National Endowment for the Arts (NEA) konnte Beck als "artist-in-residence" im National Center for Experiments in Television (im Sender KQED-TV, San Francisco) sich den Problemen der Klangvisualisierung widmen und den Prototyp weiter entwickeln. Module für Form, Bewegung, Textur und Farbe konnten im "Direct Video #1" über Spannungsregler in Echtzeit und damit in Live-Aufführungen gesteuert werden. 38

Beck, Stephen/Jepson, Warner: Illuminated Music 2 & 3, Videodokumentation von einer Sendung des PBS (Public Broadcasting Service), 1973. Links: Beck am Direct Video Synthesizer. Rechts: Becks Visualisierung von Jepsons Musik.

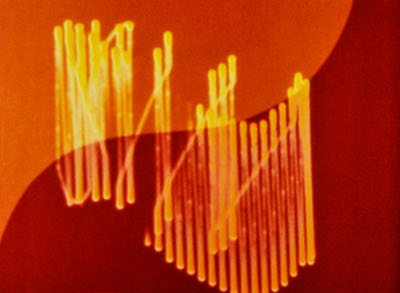

In "Illuminated Music 1" konnte Beck seinen Video Synthesizer am 19. Mai 1972 zu Yusef Lateefs Improvisationen über "Like It Is" in einer Live-Sendung des KQED-TV (San Francisco) vorführen. Aufnahmen des National Center for Experiments in Television (für eine Sendung des PBS/Public Broadcasting Service, Arlington/Virginia 1973) von "Illuminated Music 2 & 3" zeigen Warner Jepson am Buchla Synthesizer in einer Live Performance mit Stephen Beck am "Direct Video Synthesizer". Während Beck auf einer kleinen Kathodenstrahlröhre den Output steuerte, konnte das Publikum seine Visualisierung von Jepsons Musik auf Großleinwänden sehen. 39 Farbflächen mit wellenförmigen Umrissen, die andere Flächen überlagern oder verdecken, wellenförmig sich bewegende Partikel und durchgehende sowie unterbrochene Wellenlinien dominierten die Bildprojektion zu einer sich wie an- und absteigende Wellen beschleunigenden oder langsamer werdenden Musik. Die Visualisierung zeigte mehrfach, dass die Klangproduktion erst einige Wellen ausführen musste, bis erkennbare Änderungen in den visuellen Mustern eintraten.

Sandin, Dan: 5 Minute Romp Through the IP [Analog Image Processor], Video, 1973.

Dan Sandin stellt die technische Basis seines "Analog Image Processor" (1971-73) als "General Purpose Analogcomputer" vor, der über "patch cables" programmiert werden kann. Sandin hat den Analogcomputer "optimized...for processing video information...[and] television information". 40 Die über die "patch cables" aktivierbaren "processing modules" ermöglichen es, über Regler externe Bildsequenzen zu transformieren: "The instrument is programmed by routing the image through various processing modules and then out to a monitor or video tape recorder." 41 Zwischen "processing modules" und der Ausgabe für den Monitor fügt der "output color encoder" Farben hinzu. 42

Sandin demonstriert 1973 in "Triangle in Front of Square in Front of Circle in Front of Triangle", dass die mit seinem Video Tool gesteuerten Signalprozesse in der Kathodenstrahlröhre dem Konzept des perspektivischen Bildraums widersprechen:

A demonstration of the fact that thinking of video keying as putting one thing in front of another is inaccurate and limiting. The Analog Image Processor was programmed to implement the logic equations if triangle and square show triangle, if square and circle show square, if triangle and circle show circle. 43

Sandin, Dan: Triangle in Front of Square in Front of Circle in Front of Triangle, Video, 1973.

Sandin wollte beweisen, dass die Provokation des Eindrucks von Dreidimensionalität, wie sie Steina und Woody Vasulka durch die Schichtung mehrerer Ebenen mit einem "George Brown Multi-Level Keyer" (1973) erzeugten (vgl. "Golden Voyage", 1973), keine der Kathodenstrahlröhre adäquate Gestaltungsweise ist. 44 Das Videovokabular sollte – so Sandin – den perspektivischen Bildraum ersetzen.

Tom DeFanti entwickelte 1973 GRASS (Graphics Symbiosis System) für die digitalen Minicomputer PDP 11/45 der Digital Equipment Corporation (DEC, ab 1972). 45 Zweidimensionale Objekte konnten als vektorielle Animationen über Befehlseingaben in das Manual in Schwarz/Weiß erstellt und in Echtzeit auf einer Kathodenstrahlröhre kontrolliert werden. David Sturman beschreibt die Möglichkeiten von GRASS: "With GRASS, people could script scaling, translation, rotation and color changes of 2D objects over time." 46 Die Farbanimation konnte an der University of Illinois in Chicago mit einem "Sandin Analog Image Processor" (siehe oben) ausgeführt werden: Auf die digitale folgte eine analoge Animation.

DeFanti, Tom/Morton, Phil/Sandin, Dan/Snyders, Bob: Ryral, Video einer Live-Aufführung an der University of Illinois, Chicago 1976.

Dan Sandin und Tom DeFanti haben das System 1976 in "Ryral" in Echtzeit auf dem zweiten "Electronic Visualization Event" an der University of Illinois in Chicago vorgeführt: Simultan war Bob Snyders an einem "analog EMU Synthesizer" ausgeführte Musik zu hören. Aus den in Emshwillers "Scape-mates" (siehe oben) zwischen Vorder- und Hintergrund oszillierenden Tänzern wird in "Ryral" eine gelegentlich als Umrissfigur erkennbare Actrice: Kameraaufnahmen von einer Tanzperformance werden einer zweidimensionalen Bildbearbeitung zugeführt, in der Konturen und Farben Spannung besonders dann zu erzeugen vermögen, wenn die ineinander geblendeten Flächen Versuche scheitern lassen, sie als Vorder- und Hintergrund zu sortieren. Kreis- und spiralförmige Muster aus sich bewegenden gepunkteten Linien ergeben in einigen Farbkonstellationen Flimmereffekte. 47

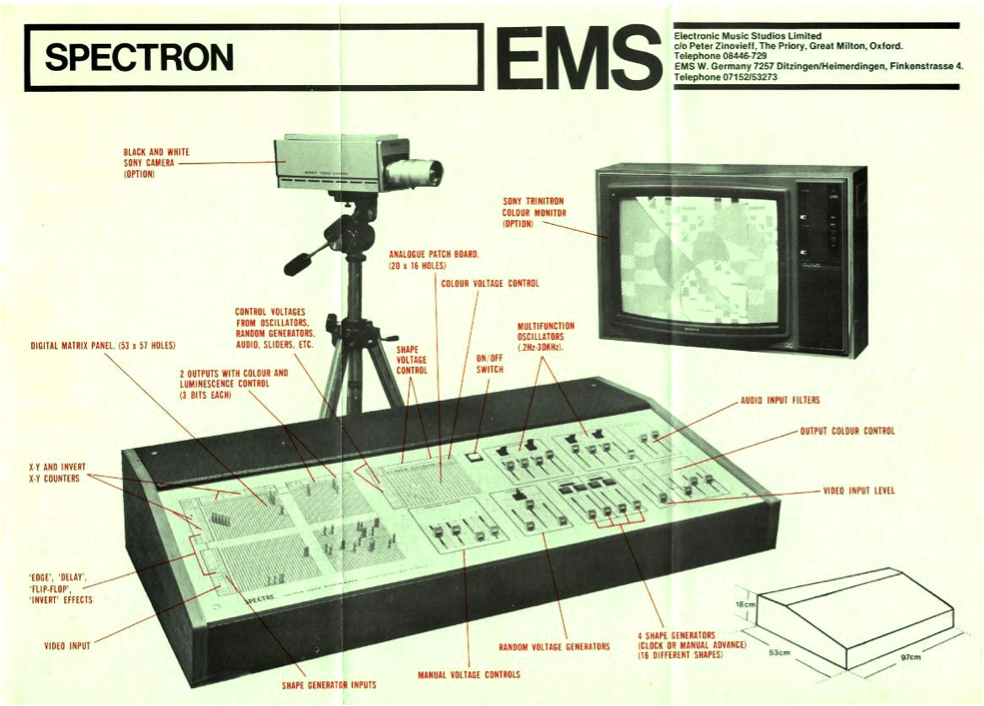

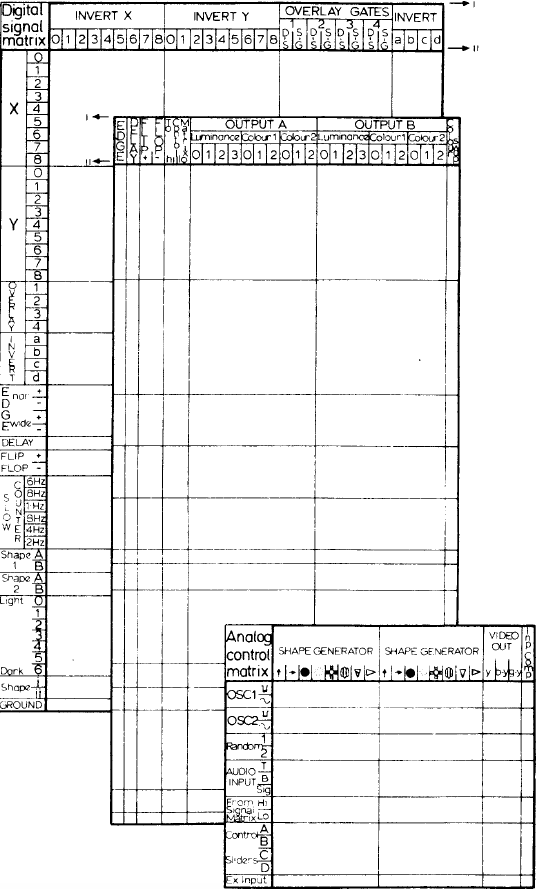

Als Richard Monkhouse den Videosynthesizer "Spectron" (1974) für die Electronic Music Studios, Ltd (EMS) in London konstruierte, übernahm er von deren VCS 3 Audio Synthesizer (1969, und von nachfolgenden Entwicklungen) das Patchboard mit Löchern für kleine Stecker ("pins"). Der Videosynthesizer hatte zwei "pinmatrix patch board[s]" 48 : die "Digital Signal Matrix" (DSM) und die "Analog Control Matrix" (ACM). Der analoge EMS Spectron wurde mit digitalen Signalen gesteuert, um den unvermeidlichen "crosstalk" zwischen "video frequencies" zu vermeiden. 49

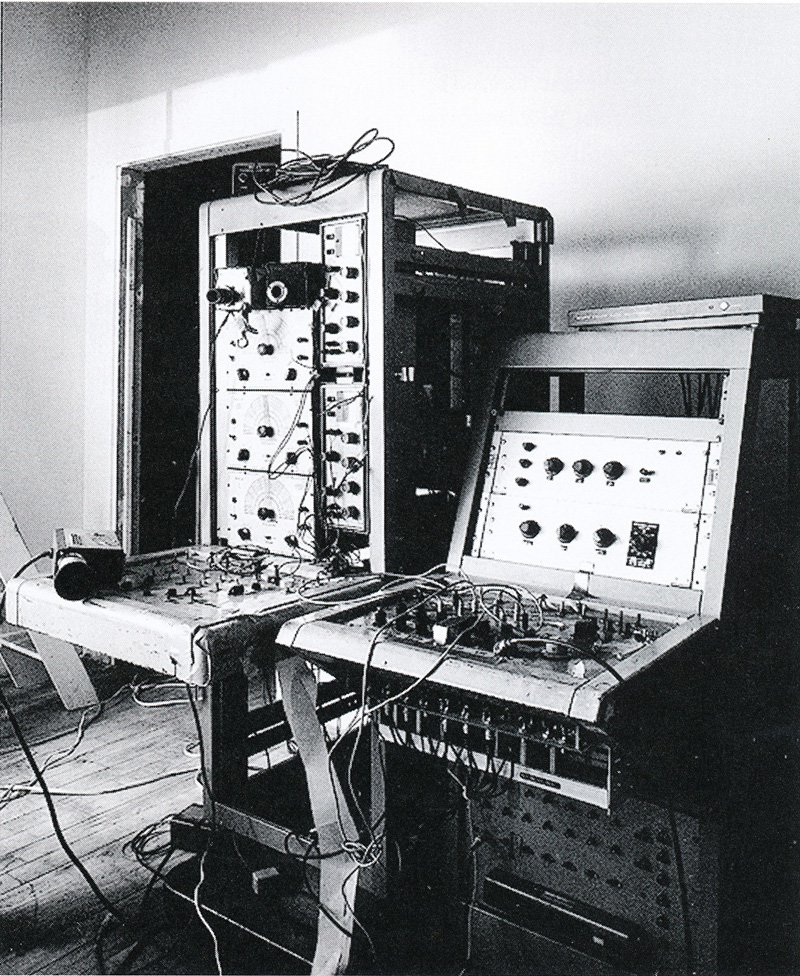

Electronic Music Studios, Ltd (EMS): Spectron, 1974.

Videosynthesizer

(Siedler: EMS o.J., S.7).

Der Videosynthesizer erzeugte Formen und Farben eigenständig. Er ließ sich aber auch einsetzen, um die Farben eines externen "Video Input Signals" zu verändern. Ein Videosignal konnte mit Farben und Mustern versehen werden, das sich dann mit einem bewegten oder statischen elektronisch generierten Bild kombinieren ließ. Mit Audiosignalen konnten Bildeigenschaften in Echtzeit verändert werden.

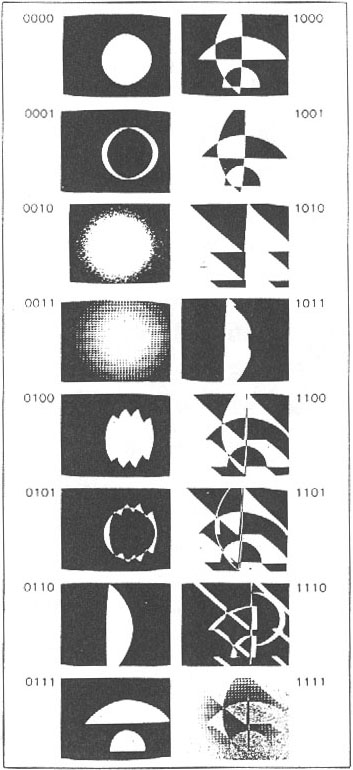

Zwei identische "Shape Generators" enthielten 16 Grundformen, die "derivatives of a circle with logic or modulation effects applied" waren und die mittels der analogen Spannungskontrolle (s.u.) verändert werden konnten. Wenn die Auswahl der Grundformen nicht manuell vorgenommen wurde, dann wechselte der Synthesizer die Grundformen "at a pre-determined rate". 50 Neben diesen internen Bildquellen war auch Input aus externen Bildquellen (Videokamera) möglich, der wiederum verändert werden konnte. Diesen Input konnten Formen und Muster überlagern, die aus internen Quellen (Grundformen) generierte statische oder bewegte Formen enthielten.

Mit den "X" und "Y counters" auf dem digitalen Patchboard (DSM) konnten statische Bilder mit horizontalen ("X") oder vertikalen Streifen mit mehreren binären Breiten erzeugt werden. "Slow counters" erzeugten sechs binäre Rechteckwellen, die für Zustandsänderungen eingesetzt wurden, um Blitz- und Bewegungseffekte zu erzeugen.

Die Ränder einer Form waren mit dem "edge generator" modifizierbar, während sich mit der "Delay"-Funktion "echo oscillations" erzeugen ließen, deren Abstände wiederum mit "flip flops" zu verändern waren, da diese die "horizontal spacial frequency of any form patched into them" halbierten.

Electronic Music Studios, Ltd (EMS): Spectron, 1974. Videosynthesizer.

Links: Digital Signal Matrix und Analog Control Matrix

(Monkhouse: Art 1974, S.26).

Rechts: 16 Grundformen (Siedler: Spectre o.J.).

Mit dem "video comparator" konnte die Grauskala eines schwarz-weißen Kamera-Input-Signals in 7 Bereiche aufgeteilt werden. Die Aufteilung konnte alle Grauwerte des Inputs einbeziehen ("Maximum) oder nur die untersten Bereiche ("Minimum"). Den 7 Graustufen entsprachen 7 Output-Reihen ("output rows"), die über die "Digital Signal Matrix" je verschieden modifizierbar waren (Farbe, Farbton, Helligkeit). Jede dieser Reihen konnte auf dem Patchboard mittels der Funktion "overlay gates" mit Muster versehen ("patterned") werden. Mittels "overlay gates" entstanden "layers of moving patterns". 51

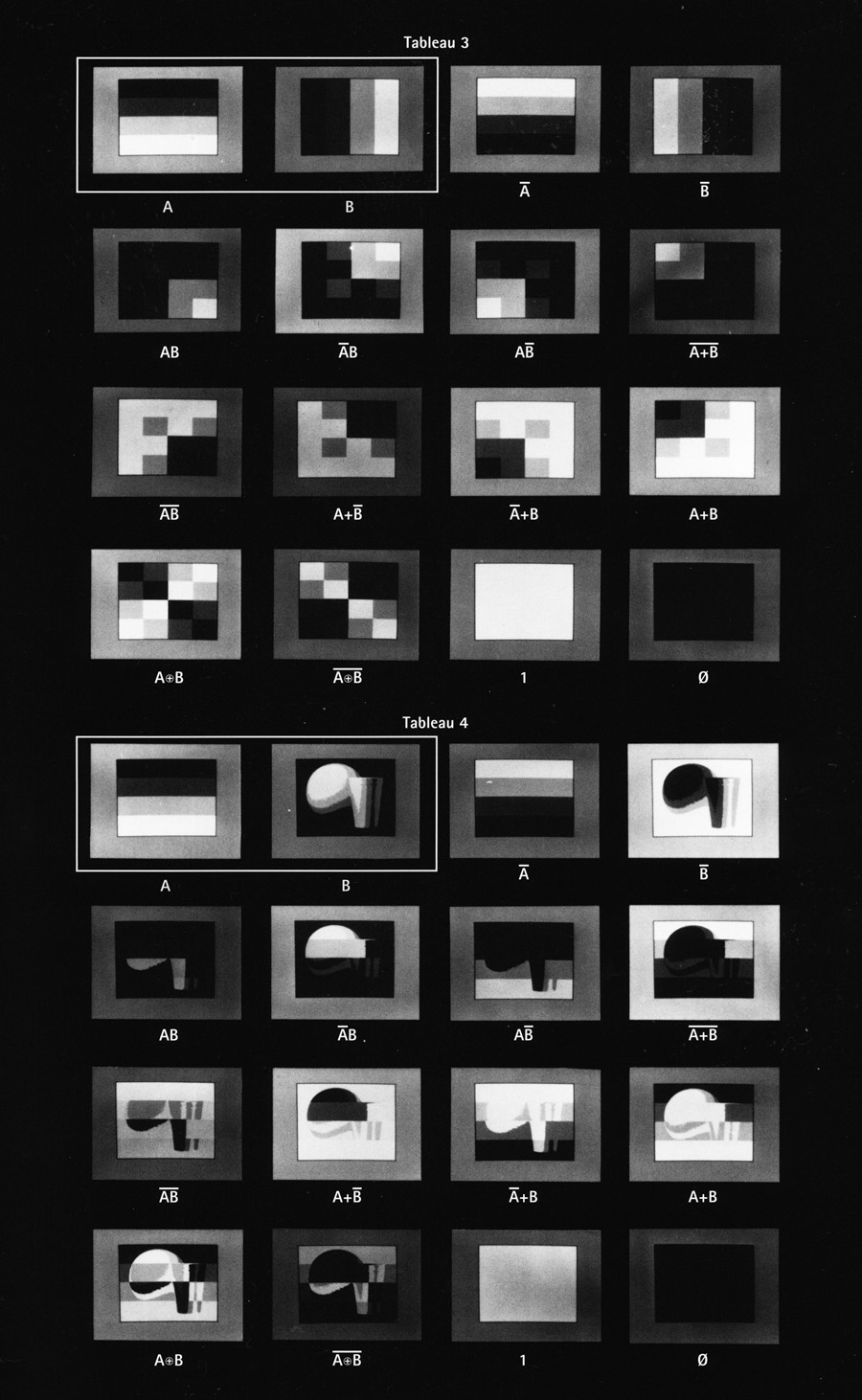

"Spectron" war in eine "Digital Signal Matrix" (DSM) und eine "Analogue Control Matrix" (ACM) unteilt. Die "Digital Signal Matrix" ermöglichte Grundform-Kombinationen nach den logischen Kriterien Konjunktion ("AND"), Disjunktion ("OR") und exklusive Disjunktion ("XOR"). 52 Mit der "Analog Control Matrix" konnte die Spannung der Output-Signale kontrolliert werden. So waren mit dieser "Matrix" "four separate shape outputs" steuerbar (Helligkeit, Farbe, Bewegung, Größe u.a.). Die beiden digitalen "shape generators" versorgten je zwei dieser "shape outputs". Weitere Veränderungen des Video-Ausgangs ermöglichten zwei Oszillatoren für Rechteck- und Sinuswellen ("Sine or square wave outputs"). Außerdem konnten "Random voltages" und Audiosignale eingesetzt werden. Die separaten "A and B outputs" konnten in verschiedenen "logical combinations" eingesetzt werden.

Wenn ein Hintergrundmuster in weiteren Filmsequenzen eingesetzt werden sollte, dann konnte es mit "Inverters" in die vorderste Ebene versetzt und weiter bearbeitet werden. 53

Jacques Guyonnet: Lucifer Photophore, Video, 1975.

In Jacques Guyonnets «Lucifer Photophore» (1975) erscheinen von dem als Leitmotiv wiederkehrenden, häufig roten Oval teilweise nur die Ränder (zum Beispiel wie flackernde Formen infolge von Rauschphänomenen). Es erscheint immer wieder in und mit Variationen der Grundformen des Spectron, die aus ineinander geblendeten Kreisen bestehen.

«Labyrinthe Fluides» von Geneviève Calame und Jacques Guyonnet (1976) gehört zu den besten Beispielen für die Möglichkeiten des EMS Spectron. Das "maze Patch" im Hintergrund des Videos «Labyrinthe Fluides» ist "one of the mysteries of the counter logic combinations". Die "digital adder" Technik wird hier mit den "X and Y counters" in einer bisher nicht rekonstruierten Weise eingesetzt. Viele, wenn nicht alle Verbindungen logisch möglicher Kombinationen eines Set aus "binary bits" können aus asymmetrischen Funktionen wie "AND" und "OR" sowie der Inversion/"symmetrical controlled inversion" "XOR" entwickelt werden. Mit der "OR"-Funktion können aus den Outputs des X Counters dünne vertikale Linien entstehen. Bestimmte "sets of pins" in derselben Reihe des DSM Patchboard ergeben eine 'verdrahtete' OR-Funktion. Wenn man jeder Inversion eines "X counter bit" eine XOR-Funktion hinzufügt, dann entsteht ein "digital adder" und aus vertikalen werden diagonale Linien. Durch Ausprobieren der Möglichkeiten können "many kinds of linear, diamond, maze and 'fractal'- like patterns" entstehen.

Dieses "maze patch" weist häufig abweichende Bewegungsrichtungen und Tempi zu den Formveränderungen der Vordergrundelementen auf. Video feedback wird in «Labyrinthe Fluides» eingesetzt, um Formen des Hintergrunds mit dem Vordergrund zu verbinden, bis sich vergrösserte Teile der Formen und Texturen wechselseitig durchdringen. Daraus ergeben sich fliessende und organische Sequenzen mit Moiré-Effekten, die Veränderungen der Linienkonfigurationen erzeugen. Wenn sich im Vordergrund abstrakte Formen in organische Muster auflösen, dann können sich Interferenzen zu Deformationen des "maze patch" im Hintergrund ergeben. Teilweise überlagert oder durchdringt das "maze patch" auch abstrakte Formen. 54

Geneviève Calame/Jacques Guyonnet: Labyrinthes fluides, Video, 1976.

EMS Spectron wurde außerdem zwischen 1977 und 1980 von Warren Burt, Robert Cahen, Richard Monkhouse und in einem Musikvideo von Plastic Bertrand (Roger Jouret) eingesetzt. 55

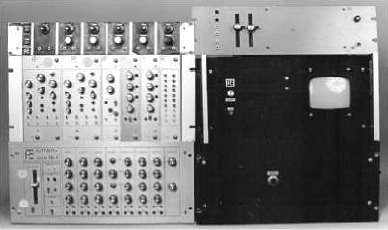

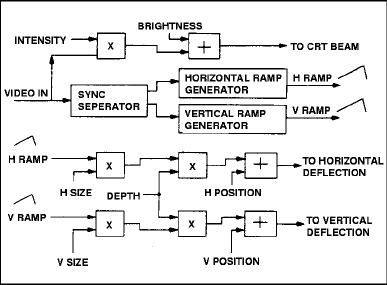

Etra, Bill/Rutt, Steve: Rutt/Etra Scan Processor, 1973.

Links: Rutt/Etra Model RE-4 Scan Processor.

Rechts: Funktionsdiagramm von Jeffrey Schier.

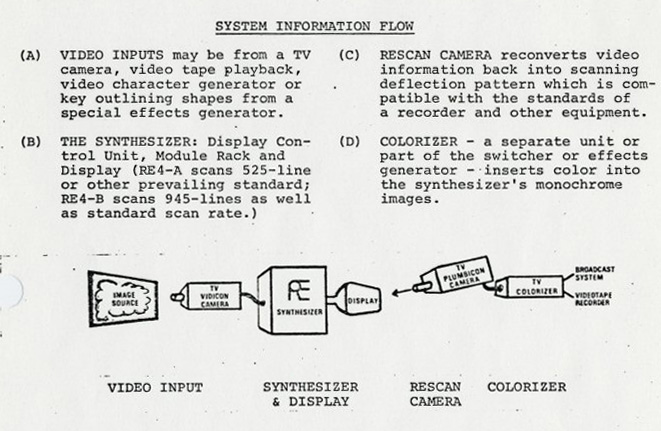

Etra, Bill/Rutt, Steve: Gebrauchsanweisung für den Rutt/Etra Scan Processor mit "System Information Flow".

(Rutt/Etra: RE Video Synthesizer Systems Models RE 4A and RE 4B 1974, S.3).

Steve Rutt, Bill und Louise Etra entwickelten 1973 einen "Scan Processor", den Nam June Paik, Steina und Woody Vasulka sowie Gary Hill in Videoproduktionen einsetzten. 56 Mit dem "Rutt/Etra Scan Processor" können Signale eines Schwarz-Weiß-Monitors verändert werden. Dies geschieht in horizontaler und vertikaler Achse durch Signale, welche die Spannung steuern. Bilder eines Video-Input können an verschiedenen Stellen des Bildrasters plaziert werden. Außerdem lassen sich die Zeitpunkte, in denen Bildteile erscheinen, verändern – Bill Etra:

The Rutt/Etra changes the time in which you see parts of the picture. It is a machine that manipulates images in time. 57

Etra, Bill /Rutt, Steve: Rutt/Etra Scan Processor, 1973. Demo von Bill Etra, Video.

Als Standardmodule des ab 1975 kommerziell vertriebenen Scan Processors wurden Waveform Generatoren, 4-Quadrantenmultiplizierer und ein Summiermessverstärker geliefert. Wahlweise wurde auch ein Rampengenerator eingebaut, durch den mehrere Bewegungen ausgeführt werden konnten. An 15 Drehknöpfen konnten Größen, Positionierung, Zoom und Intensität verstellt werden. Die transformierten Bilder zeigte der in den Prozessor integrierte Monitor. Den Monitor umgaben Ablenkspulen. Von dem die "sine, triangle, or square waves" durch die Ablenkung aufbauenden Monitor wurden die Bilder wiederum mit einer Kamera aufgenommen, koloriert und einem Videotape Recorder oder einem TV-Sendesystem zugeführt. 58

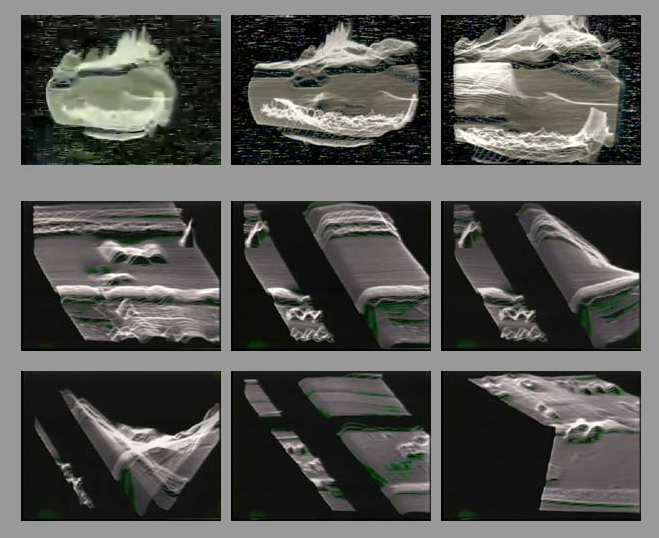

Vasulka, Woody: C-Trend, Video, 1974.

Im "Vasulka Effekt" (siehe unten) bestimmt die Helligkeit des Video Inputs eine Positionierung auf der vertikalen Achse. Heller und dunkler werdende Zonen wandern auf und ab: "When combined with other synthetic waveforms, the raster forms a three dimensional contour map where video brightness determines elevation." 59

In Woody Vasulkas "C-Trend" (1974) werden aus fahrenden Autos Sinuswellenstörungen. Straßenszenen, die mit einer in einem Fenster stehenden Kamera aufgenommen wurden, werden "erneut gescannt" und via "retiming und reposition" im "Rutt/Etra Scan Processor""abweichend moduliert", während das Straßengeräusch unverändert wiedergegeben wird. 60 Die gestaffelten Wellenlinien erleichtern Beobachtern eine räumliche Auflösung der Linien als hintereinander liegende Schichten: Simultane und kurz hintereinander folgende Störungen in mehreren Schichten ergeben den Eindruck sich bewegender Körper. Da die Datenquelle der fahrenden Autos schwer erkennbar ist, entsteht zwischen Noch-Erkennbarkeit und Schon-Bildkonstruktion ein "Zwischenreich" von Objekten in Bewegung. Den schwarzen Hintergrund ersetzt teilweise "video `noise´, in this case created by blackout intervals which normally fill the `gap´ between the scanning of singular fields." 61

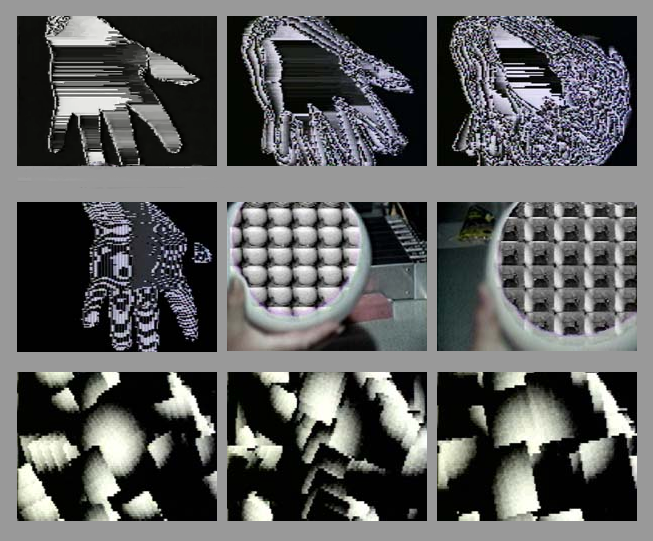

Vasulka, Woody: Artifacts, Video, 1980.

Woody und Steina Vasulka kauften einen Minicomputer DEC LSI-11 (ab 1975), eine Version des PDP-11 (PDP-11/03). Als ihr Student Jeffrey Schier Konzepte entwickelte, wie der Minicomputer zur Videobildbearbeitung eingesetzt werden kann, entstand der "Digital Image Articulator" (1976-77). 62 Das Resultat einer Programmierung lässt sich ohne erkennbare Verzögerung sehen und korrigieren. Der "Digital Image Articulator" konstituiert Bilder durch die Kombination rechteckiger Grundelemente: Die Zerlegung in diskrete Grundbausteine ersetzt die Wellenformen des "Rutt/Etra Scan Processors". Die Relationen zwischen diskreten Grundelementen "A" und "B" konstruiert Woody Vasulka in "The Arithmetic Logic Unit (ALU)" der Booleschen Algebra folgend. 63 Die neue Struktur führt zu "unusual patterns of color and box-like textures without equivalence in analog video". 64 Dies zeigt Woody Vasulka 1980 in "Artifacts": Die Struktur ist relativ grob und erscheint heute wieder relativ ungewöhnlich. Superzeichenbildung und Texturen aus mit Rechtecken gebildeten Mikrostrukturen ziehen in einigen Sequenzen abwechselnd die Aufmerksamkeit auf sich. Ein optischer Flicker aus diskreten Elementen verdichtet sich im Filmverlauf immer wieder zu erkennbaren Formationen. 65

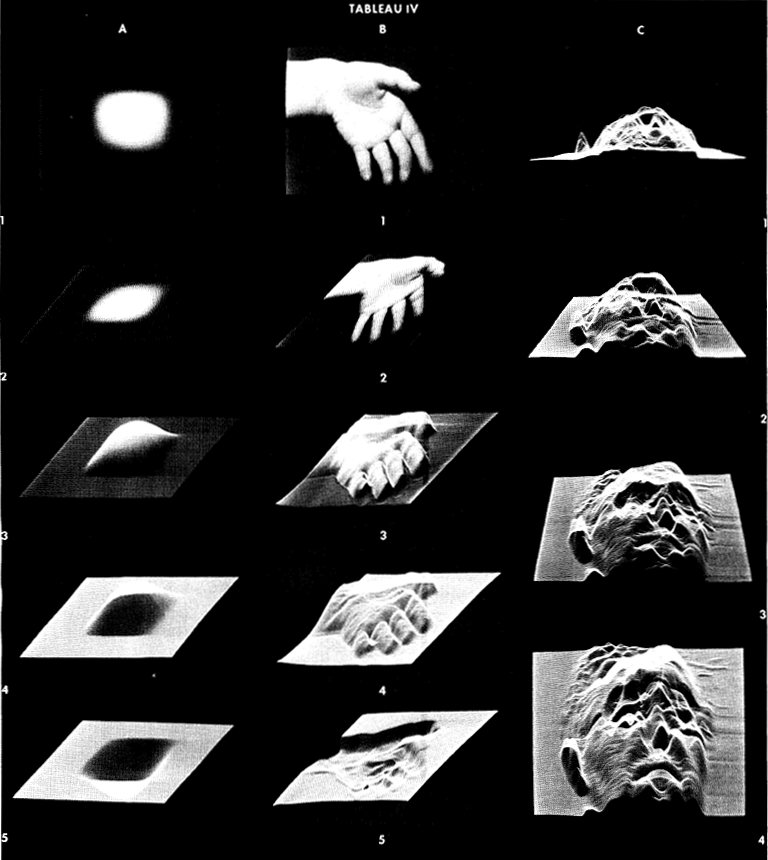

Vasulka, Woody. Links: Didactic Video, Tableau IV,

1975 (Vasulka/Nygren: Video 1975, S.13), Vorführung des Rutt/Etra

Scan Processor.

Rechts: Syntax of Binary Images, Tableau 3 & 4, 1978 (Vasulka/Weibel:

Buffalo 2008, S.423), Vorführung der Relationen zwischen diskreten

Elementen "A" und "B" in "The Arithmetic Logic

Unit (ALU)".

Die Unterschiede zwischen analoger Bildbearbeitung mit dem "Rutt/Etra Scan Processor" und digitaler Bildbearbeitung mit dem "Digital Image Articulator" führt Woody Vasulka in "Artifacts" vor, indem er die Hand als Thema wieder aufgreift, das ihm früher zur Vorführung der mit dem "Rutt/Etra Scan Processor" erzielbaren Bildsprache diente: So zeigte "Tableau IV" seines Textes "Didactic Video" (1975) vier Transformationsstufen einer Hand, die in Wellenformen konkav und konvex auf einer schrägen Ebene aus gestaffelten horizontalen Linien erscheint. In "Artifacts" dagegen erscheint eine Hand auf einer Kugel, deren Umrisse sich multiplizieren, während sich die Oberfläche der Hand in optischen Flicker auflöst. Dass die Flicker-Elemente Rechtecke und nicht flirrende Signale sind, zeigt der Vergleich der Anfangssequenz mit "Noisefields", das 1974 mit analogen Video Tools entstand: Beide Male hebt sich zwar ein Kreis vom Grund ab und verschmilzt wieder mit ihm, doch bleibt in "Noisefields" der vom Videoinput vorgegebene Kreiskontur auch und gerade in Positiv-Negativ-Umkehrungen immer erhalten, während sich in "Artifacts" mal mehr, mal weniger Kreisformen erkennen lassen, da sich die Kontur aus Rechteckkombinationen aufbaut und wieder auflöst. "Electronic Snow" liegt in "Noisefields" dem Tonrauschen wie dem visuellen Flicker zugrunde. 66

Vasulka, Woody: Noisefields, Video, 1974.

"Artifacts" zeigt die digitale Transformation in maschineller Entwicklungszeit – ohne die in der Computeranimation übliche nachträgliche Beschleunigung. Die neuen Funktionen, Bilder aufzubauen und zu bearbeiten, zeigt Vasulka "in a spirit of exploration" (Offtext zu Beginn des Filmes). Der Film enthält auch dem Pointillismus, Kubismus und Surrealismus nahestehende Darstellungsmodi, während der Ton die Signalverarbeitung als einheitliche technische Grundlage der Ton- und Bildbearbeitung betont. Vasulka erklärt zu Beginn des Films:

By artifacts I mean that I have to share the creative process with the machine. It is responsible for too many other elements in this work.

Bei der Verbreitung der Videosynthesizer und Prozessoren wählten ihre Autoren nicht nur gängige Wege des Verkaufs:

Dan Sandin und Phil Morton erweiterten in den siebziger Jahren den "Analog Image Processor" zur offenen Entwicklerplattform, der sie den Namen "Distribution Religion" gaben. Der "Sandin Analogue Image Processor" konnte mit (gegen Unkosten für die Kopien) bestellbaren Plänen nachgebaut und weiter entwickelt werden. Die Resultate von Entwicklungen konnten wiederum in die Baupläne aufgenommen werden. Der "Sandin Analogue Image Processor" und Phil Mortons Videowerke wurden mit Mortons "Copy-It-Right"-Lizenz verteilt, die zu Kopien und ihrer Verbreitung auffordert. 67

Nachdem Seth Siegelaub im Katalog der documenta 5 (Kassel, 1972) einen Vertrag publizierte, der die Verwertungsrechte des Künstlers erweitert und ihn an Gewinnen zukünftiger Verkäufe beteiligt 68, gingen Dan Sandin und Phil Morton den entgegengesetzten Weg und beseitigten die Beschränkungen, welche durch Urheber- oder Patentrechte und Verwertungen dieser Rechte für die Verbreitung und Entwicklung entstehen.

Dan Sandins Verbreitungspraxis der Baupläne seines "Analog Image Processors" und der kommerzielle Vertrieb des Rutt/Etra Scan Processors sind Gegenmodelle. An diesem Gegensatz hat sich in den Auseinandersetzungen um Urheberrechte bis heute wenig geändert. Sandin schrieb:

The Image Processor may be copied by individuals and not-for-profit institutions without charge, for-profit institutions will have to negotiate for permission to copy.

Heute können Autoren dank der von Creative Commons zur Verfügung gestellten Alternativen anzeigen, in welchen Teilen des Urheberrechts sie von einer Verwertung absehen. Mit einer dieser Alternativen lässt sich ausschließlich die nicht kommerzielle Vervielfältigung und Verbreitung frei stellen. Vergütungen für kommerzielle Anwendungen müssen dann nach wie vor mit dem Autor geklärt werden. 69

Der Einsatz von Video auf Seiten der Aktivisten und auf Seiten der Experimentalfilmer setzt die Entwicklung von Alternativen zum Rollenspiel im Spielfilm fort, die Experimentalfilmer der fünfziger und sechziger Jahre in Animationstechniken für Kaderbearbeitung vorantrieben. Die Kamera als abbildende und als von bildgebenden Verfahren ersetzbares Objekt bilden zwei Enden einer Skala. Diese zwei Enden gab es bereits in Gegenpositionen wie der zwischen Andy Warhols Factory-Filmen ("Sleep", 1963 u.a.) einerseits und andererseits den strukturellen Filmen von Peter Kubelka ("Arnulf Rainer", 1958-60), Tony Conrad ("The Flicker", 1966) oder Paul Sharits ("Ray Gun Virus", 1966). 70 Aus der statischen Kamera in Warhols Factory wird in den siebziger Jahren die mobile Videoausrüstung der Aktivisten und aus der Selbstdarstellung der Akteure vor der Kamera wird die kritische Selbsteinbettung der Filmenden und Gefilmten in ihr soziales Umfeld. Aus Warhols Negation einer Regie-abhängigen Filmsprache wird eine Erneuerung der Filmdokumentation und der TV-Nachrichtenformen. Der Kaderschnitt des strukturellen Films wird von den Autoren experimenteller Videofilme in Lenkungen des Elektronenstrahls in der Kathodenstrahlröhre durch Video Tools umgewandelt, was zum Beispiel in "Noisefields" zu einer veränderten Bedeutung des "Flickers" führt, der im strukturellen Film aus der Thematisierung des Films als Material durch Bildschnitt und Kaderkombination entstand. Die Kritik, welche mit der Suche nach neuen Filmformen am etablierten Spielfilm betrieben wurde, wird im Videogebrauch erweitert zur Fernsehkritik (s. Kap. IV.1.1). Vor dem Hintergrund der ausgeloteten Möglichkeiten der Videotechnik erscheint "Commercial Broadcast" formal wie inhaltlich reduziert.

Einerseits entwickelten die Konstrukteure der Video Tools neue Produktionsmittel und zeigten teilweise selbst die Möglichkeiten auf, mit ihnen eine videospezifische Filmsprache zu entwickeln, andererseits interessierten sich die Videoaktivisten dafür, die Videokamera als Mittel zu kritischen Äußerungen einzusetzen und die so von Betroffenen produzierten Dokumente zu senden oder Kopien auf Videokasetten zu verschicken. Auf der experimentellen Seite wurden die Signalprozesse relevant, auf der aktivistischen Seite die mobile Kamera. Die Medienexperimente führten zu neuen Produktionsmitteln und neuen Wegen der Distribution dieser Mittel ("Distribution Religion", s.o.), während die Medienaktivisten die sozialen Verhältnisse mit neuen Formen der Anwendung verfügbarer Produktionsmittel und der Verbreitung der Resultate (Community TV, s. Kap. IV.1.1) thematisierten.

Dr. Thomas Dreher

Schwanthalerstr. 158

D-80339 München.

Homepage

mit zahlreichen kunstkritischen Texte, u.a. zur Konzeptuellen Kunst und

Intermedia Art.

Copyright © (as defined in Creative

Commons Attribution-NoDerivs-NonCommercial 1.0) by the author, January

and April 2012, June 2014/August 2015.

This work may be copied in noncommercial contexts if proper credit is

given to the author and IASL online.

For other permission, please contact IASL

online.

Wollen Sie dazu Stellung nehmen oder einen eigenen Tipp geben? Dann schicken Sie uns eine E-Mail.

Anmerkungen

1 Russett/Starr: Animation 1988, S.32-177. zurück

2 Dunn/Vasulka/Weibel: Eigenwelt 1992; Miller Hocking: Principles 1978; Russett/Starr: Animation 1988, S.178-210; Spielmann: Video 2005, S.78-96,151-191. zurück

3 Dunn/Vasulka/Weibel: Eigenwelt 1992, S.96-103. zurück

4 Sony CV/VCK 2000, ab 1965: o.A.: Sony CV 2000 o.J.; o.A.: Sony CV Series Video o.J.; Sherman: Birth 2007. zurück

5 über Sony Porta Pak und ihre unterschiedliche Bedeutung für

Videoaktivisten und Experimentalfilmer: Vasulka: Sony CV Portapack 1992.

Sony CV 2400 Porta Pak, ab 1968: o.A.: Sony DVK-2400/VCK 2400 o.J.; Miller Hocking: Texts 1992.

Sony Porta Pak AV 3400, ab 1969/70: Bensinger: Video 1981, S.157ff.,161,164,166f.,172,174; o.A.: SONY AV-3400 PORTA PAK o.J. zurück

6 Murphy: Television 1997, Chapter "Local Television News Archives": "In the mid-1970's, a period marked by the transition from 16mm news film to 3/4-inch U-matic cassettes, about 700 commercial television stations were operating in the United States. Less than 10% of the stations transferred their news film to public archives. The rest was mostly destroyed." zurück

7 o.A.: Program Guide 1972, o.P.: "In issue one, volume one of Radical Software (Summer, 1970) we introduced the hypothesis that people must assert control over the information tools and processes that shape their lives in order to free themselves from the mass manipulation perpetrated by commercial media in this country and state controlled television abroad. By accessing low cost 1/2" portable videotape equipment to produce or create or partake in the information gathering process, we suggested that people would contribute greatly to restructuring their own information environments: YOU ARE THE INFORMATION...Through such decentralization of the information medium, we asserted that the overall information environment of this country could be humanized and revitalized." zurück

8 Stoney, George: First Transmission of ACTV, Video, s/w, Ton, 8 Min., 1972. zurück

9 Video, 4 Min. 23 Sek., s/w, Ton, in: Nadeau: Medium 2006, S.53,57-62; Youngblood: Cinema 1970, S.343f. zurück

10 Barzyk, Fred: The

Medium is the Medium, WGBH-TV, Boston, 23.3.1969: Nadeau: Medium 2006,

S.34-72.

Paik, Nam June: Electronic Opera #1, WGBH-TV, Boston, 23.3.1969: Decker:

Paik 1988, S.150,152,193,200, Abb.99; Fifield: Paik/Abe Synthesizer 2000;

Joselit: Feedback 2007, S.48f.; Nadeau: Medium 2006, S.64-67; Youngblood:

Cinema 1970, S.306. zurück

11 Paik/Abe Synthesizer im WGBH-TV, Boston: Decker:

Paik 1988, S.151; High: Mods 2014, S.367. Vorher soll der Sender WNET

(Channel 13 in New York City) einen Prototyp gekauft haben (o.A.: Paik-Abe

Video Synthesizer o.J.).

Paik, Nam June/Atwood, David: Video Commune – The Beatles from Beginning

to End, WGBH-TV, Video, 8 Min. 36 Sek., Farbe, stumm, 1970 (Filmdokumentation:

Yud Yalkut, 1972-92): Decker: Paik 1988, S.152; Fifield: Paik/Abe Synthesizer

2000. zurück

12 VanDerBeek, Stan: Violence Sonata, WGBH-TV, Boston, 12.1.1970: Davis: Experiment 1975, S.111; o.A.: Vanderbeek o.J.; O´Grady: Vanderbeek 1970.

Knowlton, Kenneth/VanDerBeek, Stan: Poemfields, 1964, in: Auzenne: Visualization 1994, S.29f.,45; Youngblood: Cinema 1970, S.246-249; s. Kap. IV.2.1.2.

Weitere Experimente mit Participation TV:

Davis, Douglas: Electronic Hokkadim, WTOP-TV, Washington D.C., 12.6.1971. In: Ross: Davis 1972, o.P.; Deecke: Davis 1978, S.7.

Davis, Douglas: Talk Out: A Telethon, WCNY-TV, Syracuse/New York, 1.12.1972. In: Davis: Talk Out 1973; Deecke: Davis 1978, S.6ff.,17,96; Torcelli: Video 1996, S.24. zurück

13 Paik: o.T. 1971. zurück

14 Gigliotti: History 2003; Joselit: Feedback 2007, S.93-99. zurück

15 "Bewußtseins-Industrie": Enzensberger: Aporien 1962/1980, S.60,68,73; Enzensberger: Baukasten 1970/1997, S.97-101,106f.

"Participatory democracy": Hill: Attention 1996, S.2 mit Anm.8 (Verweis auf: Students for a Democratic Society (SDS): Port Huron Statement, 1962). zurück

16 So zum Beispiel bei "ANIMAC" (1959/60),

"SCANIMATE" (1969) und dem "Rutt/Etra Scan Processor"

(1973, s.u.).

Außerdem wird im "Video Feedback" das Resultat, wie es

der Monitor eines Videosynthesizers präsentiert, von einer Kamera

aufgenommen und wieder dem Videosynthesizer zur weiteren Bearbeitung zugeführt

(Jones: Synthetics 2011, S.205ff.). zurück

17 Bute: Abstronics 1954 (Zitate).

Naumann: Sound 2009, S.279: Ralph K. Potter "entwarf ein speziell

angefertigtes Gerät, über dessen Knöpfe und Schalter sie

verschiedene Parameter der entstehenden Lissajous-Kurven beeinflussen,

ihre Position in der Fläche, ihre Geschwindigkeit und ihre Leuchtkraft

verändern sowie den Eindruck von Dreidimensionalität erzeugen

konnte." Vgl. Betancourt: History 2013, S.88f.; Kane: Algorithms

2014, S.132; Naumann: Sound 2009, S.48ff., 279f.; Zinman: Cicuit 2012,

S.140f. Oszillographen zur Erzeugung von Filmanimationen wurden auch von

Hy Hirsh ("Divertissement Rococo", 1951; "Eneri",

1953; Come Closer,

1953. Lit.: Betancourt: History 2013, S.140) und Norman McLaren (Around

Is Around, 1951, mit Evelyn Lambart) eingesetzt (Naumann: Sound 2009,

S.279). Für die erste Hälfte der fünfziger Jahre kennt

d.A. außer Mary Ellen Bute keinen mit einem für Animationen

umgebauten Oszillographen Filme erzeugenden Künstler. zurück

18 Franke: Grafik 2014 (Zitat); Gespräch mit Herbert

W. Franke am 13.8.2014 in Puppling bei Egling/Bayern und e-Mails vom 17.

und 21.8.2015 (Zitate).

Oszillograph: Firma Siemens (mit der Bezeichnung "Vorführgerät"),

mit einem scharfzeichnenden Monitor, Durchmesser 10 bis 12 cm. Der Oszillograph

von Siemens wurde unter Anderem für die Vorführung von "Bildern

von Wechselströmen" eingesetzt. Der scharfzeichnende Bildschirm

ermöglichte es Franke, Linien "so nahe aneinander[zu]schieben...,

dass dabei Hell-Dunkelübergänge, und damit eindrucksvolle Verläufe,

zustande kamen." Mit den "dick gezeichneten Linien" des

von ihm vorher verwendeten Oszillographen (s. Kap. III.2.1) war dies Franke

noch nicht möglich (Franke, e-Mail 17.8.2015). zurück

19 «Luminoscope I», 1959. In: Cassou/Habasque/Ménétrier:

Schöffer 1963, S.86 (Zitat).

Variations

luminodynamiques 1, 1961. Film,

16mm, s/w, Ton. Collection Centre Pompidou, Paris. In: Cassou/Habasque/Ménétrier:

Schöffer 1963, S.86-89. Ich danke Jean-Noel Montagné für

den Hinweis auf Schöffers videografische Experimente. zurück

20 Während Jeffrey Schier angibt, dass "ANIMAC was developed in the early 1960´s" (Schier: Scan Processors 1992, S.94), legt sich Walter Funk auf die Jahreswende 1959/60 (s.o.) als Datum der Realisation der "first version" fest, ohne Dokumente als Beleg anzugeben (Funk: Animac 2010, S.53). Weitere Lit.: Funk: Animac 2010, S.53f.,58 (Zitate); Harrison: We 1992; Schier: Scan Processors 1992, S.93ff.; Smith: Computers 1974, S.149; Youngblood: Cinema 1970, S.200. zurück

21 Siehe TV- bzw. Kathodenstrahlröhren-Manipulationen

von Nam June Paik (Fernseher mit gestörten Monitoren in der Ausstellung

"Exposition of Music – Electronic Television, Galerie Parnass,

Wuppertal, März 1963; Magnet

TV, 1965) und Wolf Vostell (Fernseher mit gestörten Monitoren

in der Ausstellung "TV Decollage", Smolin Gallery, New York,

Mai 1963; Sun in

Your Head, Film, 1963).

Stan Ostoja-Kotkowski manipulierte in den frühen sechziger Jahren

einen Fernseher und fand 1962 einen Ingenieur (Malcolm Kay?) der Philips

Research Laboratories in Hendon/South Australia, der für ihn ein

Gerät mit Oszillatoren zur Lenkung der Elektronen in der Röhre

eines Fernsehers erstellte. Ostoja-Kotkowski stellte seine mit dieser

Ausrüstung erstellten "electronic drawings" im Juli 1964

zum ersten Mal in der Argus Gallery in Melbourne aus (Jones: Synthetics

2011, S.126-129,131f. mit Fig.5.8ff.; Meigh-Andrews: History 2014, S.10f.,14).

zurück

22 Meigh-Andrews: History 2014, S.135; Zinman: Circuit 2012, S.146f. zurück

23 Meigh-Andrews: History 2014, S.135,209-212; Youngblood: Cinema 1970, S.331-334; Zinman: Circuit 2012, S.147. zurück

24 Robert Cahen 2005. In: Meigh-Andrews: History 2014, S.138. zurück

25 Meigh-Andrews: History 2014, S.137s. Meigh-Andrews nennt außerdem Dominique Belloir, Olivier Debré und Piotr Kamler als Künstler, die Videos mit dem «Truqueur Universel» schufen. Weitere Künstler: Jean-Paul Cassagnac, Peter Foldes, Martial Raysse (Langlois: Schaeffer 2010). zurück

26 Youngblood: Cinema 1970, S.314ff. Meigh-Andrews: History 2014, S.138f.; Kane: Algorithms 2014, S.71-74. zurück

27 Hill: Siegel 1996. zurück

28 Betancourt: History 2013, S.167ff.; Funk: Animac 2010, S.53; Youngblood: Cinema 1970, S.200; Schier: Scan Processors 1992, S.95; Smith: Computers 1974, S.149,151f. zurück

29 Scape-Mates: 28 Min 16 Sek., Farbe, Ton, in:

Russett: Robert: Interview Ed Emshwiller (1974). In:

Russett/Starr: Animation 1988, S.207; Spielmann: Video 2005, S.156f.

Im Chromakey-Verfahren

kann eine aus einem Farbwert bestehende Bildebene durch einen einzublendenden

Film ersetzt werden. Sich vor der Einblendungsebene bewegende Objekte

bleiben erhalten. So können sich Fernsehmoderatoren vor einem Film

bewegen, der auf die für dieses Verfahren meist blau gefärbte

Studiowand projiziert wird. zurück

30 o.A: Scape-mates o.J. zurück

31 Youngblood: Cinema 1970, S.194: "...at a rate of 100,000 per second within a field of 16.000 possible xy coordinates". zurück

32 Spielmann: Video 2005, S.11f.

Zur Kathodenstrahlröhre als Ausgabemedium für Vektoren und Rasterbilder:

Johnson: Synthetics 2011, S.40,43f.

Magnetband, erste Videocassetten: Sony

U-matic, ab 1971. In: Bensinger: Video 1981, S.131-145. zurück

33 Schier: Paik-Abe Video Synthesizer 1992. Vgl. Betancourt: History 2013, S.163-167; Decker: Paik 1988, S.150f.; Furlong: Notes [1] 1983, S.36 mit Anm.13; High: Mods 2014, S.365ff.; Joselit: Feedback 2007. S.47-50; Meigh-Andrews: History 2014, S.135f.; Spielmann: Artists 2014, S.518f.; Spielmann: Video 2005, S.168-171. zurück

34 Schier: Eric Siegel EVS Synthesizer 1992. zurück

35 Yalkut: Electronic Video Synthesizer 1977/78. Vgl. Dolanova/Vasulka: Vasulka 2014, S.286. zurück

36 Furlong: Notes [1] 1983, S.36; Sturken: TV 1984, S.8. zurück

37 Buchla Synthesizer: Buchla 100 Series, 1964, in: Dunn/Vasulka/Weibel: Eigenwelt 1992, S.96-99. zurück

38 Beschreibung der Module, in: Schier: Direct Video Synthesizer 1992, S.124f. zurück

39 Beck: Beck Direct Video Synthesizer 2000; Beck: Music o.J.; Beck: Video o.J.; Furlong: Notes [1] 1983, S.37. Beck und Jepson verwendeten in Aufführungen von "Illuminated Music 2 & 3" Videoprojektoren vom Typ "Eidophor GE Light Valve". zurück

40 Dan Sandin in "5 Minutes Romp thru the IP", 1973, Video, s/w, Ton, 3 Min. 52 Sekunden. In: URL: http://www.youtube.com/ watch?v=8qh6jRzjmcY (17.12.2011). zurück

41 Dan Sandin, in: Morton, Phil/Sandin, Dan/Wiseman, Jim: In Consecration of a New Space. A Color Video Process. Informationsblatt, 26.1.1973. Zit. nach: Spielmann: Video 2005, S.170 mit Anm.69. zurück

42 Schier: Image Processor 1992. Vgl. Miller Hocking: Grammar 2014, S.461; Spielmann: Artists 2014, S.507f. zurück

43 Dan Sandin 2004. In: Spielmann: Video 2005, S.170 mit Anm.69. Vgl. Dolanova/Vasulka: Vasulka 2014, S.289f. zurück

44 Brown, George: Multikeyer, 1973. In: Schier: Multi-Level-Keyer 1992; Spielmann: Video 2005, S.176f.,333f. zurück

45 Magnenat-Thalmann/Thalmann: Computer Animation 1990, S.31,33. zurück

46 Sturman: State 1998. zurück

47 Cates: Ryral 2009. zurück

48 Siedler: Spectre o.J. zurück

49 Monkhouse: Art 1974, S.22: "Signals on this patchboard are carried in digital form because crosstalk problems at video frequencies make an analog patchboard well nigh impossible." zurück

50 Siedler: EMS o.J. zurück

51 Monkhouse: Art 1974, S.22ff. zurück

52 EMS: User o.J. zurück

53 EMS: User o.J.; Monkhouse: Art 1974, S.23,26 (Zitate); Siedler: EMS o.J. (Zitate); Siedler: Spectre o.J. (Zitate); Jeffrey Siedler, e-Mail vom 25.8.2015 (Zitate). zurück

54 Siedler: Secrets o.J.; Jeffrey Siedler, e-Mail vom 18.8.2015 und 25.8.2015 (Zitate). zurück

55 Warren Burt: Three Texts, 1977 (mit Stephen Jones); Five Moods (3x4x) (for Ned Sublette), 1979; Return to Uranus (after Ruggles) Veils 2, 1979; Watermusic Dazzler (after Monk), 1979, Georgeous Formalisms (Even 5 More Moods, Yet), 1979. Robert Cahen: Sans titre, 1977; L´Eclipse, 1979; Trompe l´oeil, 1979; L´ent´apercu, 1980. Richard Monkhouse: Shine on You Crazy Diamond, 1977; Transform, 1978. Plastic Bertrand: Ca plane pour moi, 1978 (Meigh-Andrews: Donebauer 2007, S.464; Meigh-Andrews: History 2014, S.158f. Ich danke Jeffrey Siedler für Hinweise zu Anwendern des "EMS Spectron" sowie für Korrekturen und die Sendung von Informationsmaterial). zurück

56 Der "Rutt/Etra Scan Processor":

– in Nam June Paiks Videos: Spielmann: Video 2005, S.256f. (über "Global Groove", 1973); Spielmann: Video 2009, Kap.4.

– in Steina und Woody Vasulkas Videos: Spielmann: Video 2009, Kap.4; Hatanaka/Koizumi/Sekiguchi: Vasulka 1998, S.14ff.,21,34,42,46,48; siehe unten.

– in Gary Hills Videos: Broeker: Hill 2002, S.96-99; Furlong: Manner 1983, S.13 (über "Videograms", 1980-81, und "Happenstance (part one of many parts)", 1983); Spielmann: Video 2005, S.185; Spielmann: Video 2009, Kap.4. zurück

57 Zit. in Miller Hocking: Rutt/Etra 1986. zurück

58 Miller Hocking: Grammar 2014, S.458,460; Miller Hocking: Rutt/Etra 1986; Rutt: What 1992; Rutt/Etra: RE Video Synthesizer Systems Models RE 4A and RE 4B 1974; Schier: Rutt/Etra 1992; Spielmann: Artists 2014, S.519ff.; Vasulka/Nygren: Video 1975, S.9. zurück

59 Schier: Rutt/Etra Scan Processor 1992, S.139. Vgl. Spielmann: Video 2005, S.341. zurück

60 Spielmann: Video 2005, S.340. zurück

61 Dolanova/Vasulka: Vasulka 2014, S.291. Vgl. Meigh-Andrews:

History 2014, S.152.

"Zwischenreich": Klee: Denken 1964, S.91f.,313. zurück

62 Steina Vasulka dokumentierte dessen Entwicklung 1980 in dem Video "Cantaloup", in: Hatanaka/Koizumi/Sekiguchi: Vasulka 1998, S.20; Vasulka/Weibel: Buffalo 2008, S.496f. zurück

63 Vasulka/Hagen: Syntax 1978. zurück

64 Schier: Digital Image Processor 1992, S.145. zurück

65 Furlong: Notes [2] 1983, S.16; Spielmann: Artists

2014, S.516f.; Spielmann: Video 2005, S.345f.; Vasulka/Weibel: Buffalo

2008, S.448f.,452f.

Eine Anwendung des "Digital Image Articulator" vor "Artifacts" zeigt "Bad", 1979, in: Spielmann: Video 2005, S.347f. mit Abb.120; Vasulka/Weibel: Buffalo 2008, S.496f. zurück

66 "Didactic Video", "Tableau IV":

Vasulka/Nygren: Video 1975, S.13.

Über die Digitalisierung in "Artifacts": Dolanova/Vasulka:

Vasulka 2014, S.296ff.; Spielmann; Video 2005, S.345f. mit Abb.137f.;

Spielmann: Woody Vasulka 2004; Sturken: Artifacts 1996; Vasulka/Weibel:

Buffalo 2008, S.461.

"Noisefields": Dolanova/Vasulka: Vasulka 2014, S.288; Spielmann:

Video 2005, S.338f.; Spielmann: Video 2009, Kap.4. zurück

67 Cates: Copying-It-Right 2008; Cates: Copying-It-Right 2014; Furlong: Notes [1] 1983, S.38; Sandin: Distribution Religion 1992; Sandin/Morton: Distribution Religion 2014; Schier: Image Processor 1992, S.134. zurück

68 Siegelaub: Artist´s Reserved Rights Transfer and Sales Agreement 1972. zurück

69 Sandin: Distribution Religion 1992 (Zitat); Sandin/Morton: Distribution Religion 2014. Vgl. die Auswahl an Lizenzen, die Creative Commons bietet, in: URL: http://creativecommons.org/choose/ (22.12.2011). zurück

70 Hein: Film 1971, S.103,106; Hein: Structural Film 1979, S.96f.; Sitney: Film 1974, S.409ff.,424f.; Vasulka/Weibel: Buffalo 2008, S.315f.,542f. zurück

[ Inhaltsverzeichnis | Bibliographie | nächstes Kapitel ]

[ Anfang | Index NetArt | NetArt Theorie | Home ]